时间:2026-01-20 11:28

人气:

作者:admin

最近和多家企业的AI技术负责人深度交流,发现一个共性痛点:RAG(检索增强生成)作为解决大模型“知识过期”“幻觉”的核心技术,80%的团队都在选型上栽了跟头——要么用轻量方案硬扛大规模数据,导致检索延迟飙升至3秒以上;要么用复杂方案给小场景做“过度设计”,服务器成本翻倍却没提升效果。

印象很深的一个案例:某教育公司初期为了“一步到位”,直接上了“RAG+微调+分布式向量库”的复杂架构,处理仅5万条的课程文档,结果P99响应时间高达2.8秒,每月服务器成本多花2万;后来调整为基础RAG方案,配合轻量级向量库,响应时间压到280ms,成本直接降低70%。

反过来,某电商平台曾用基础RAG处理1000万条商品FAQ,召回率不足60%,用户长尾问题大多无法匹配;升级为“增强RAG+混合检索”后,召回率提升至92%,客服咨询效率提升40%。

这两个案例戳中了RAG选型的核心矛盾:没有“最好的方案”,只有“最适配场景的方案”。对于中级及以上技术人员来说,选型的关键不是罗列技术特性,而是掌握“场景-指标-方案”的匹配逻辑,以及不同场景下的实操落地技巧。

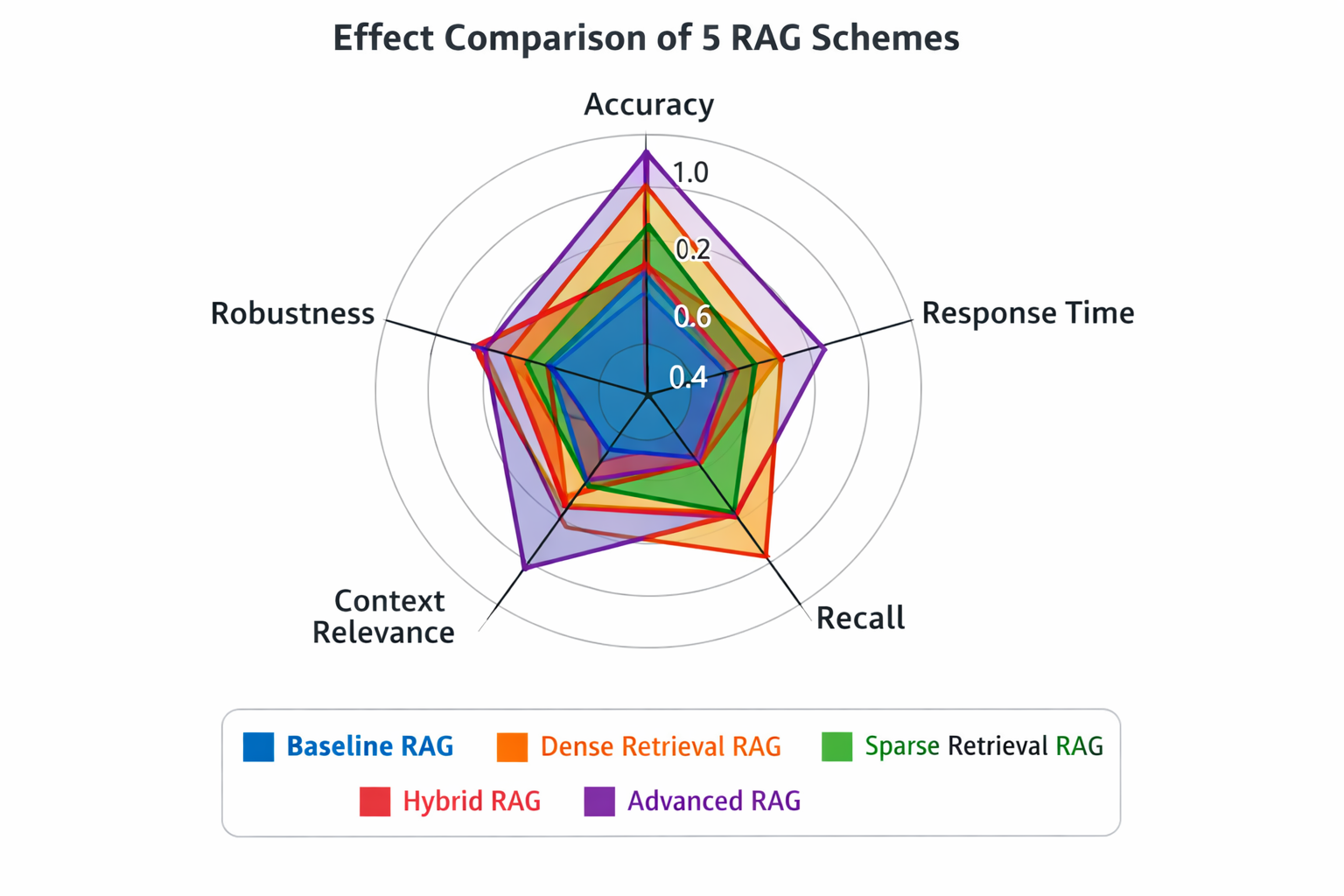

今天这篇文章,基于10+企业级RAG落地经验,拆解5种主流RAG方案的底层逻辑、实测效果,给出“轻量场景(数据量<10万条,并发<100 QPS)”和“大规模场景(数据量>100万条,并发>500 QPS)”的选型框架与实操步骤,帮你精准避坑。

在讲选型前,先理清RAG的核心逻辑:RAG本质是“检索+生成”的组合,通过检索工具从私有知识库中抓取相关信息,再传给大模型生成答案,核心解决“大模型没学过的知识”问题。

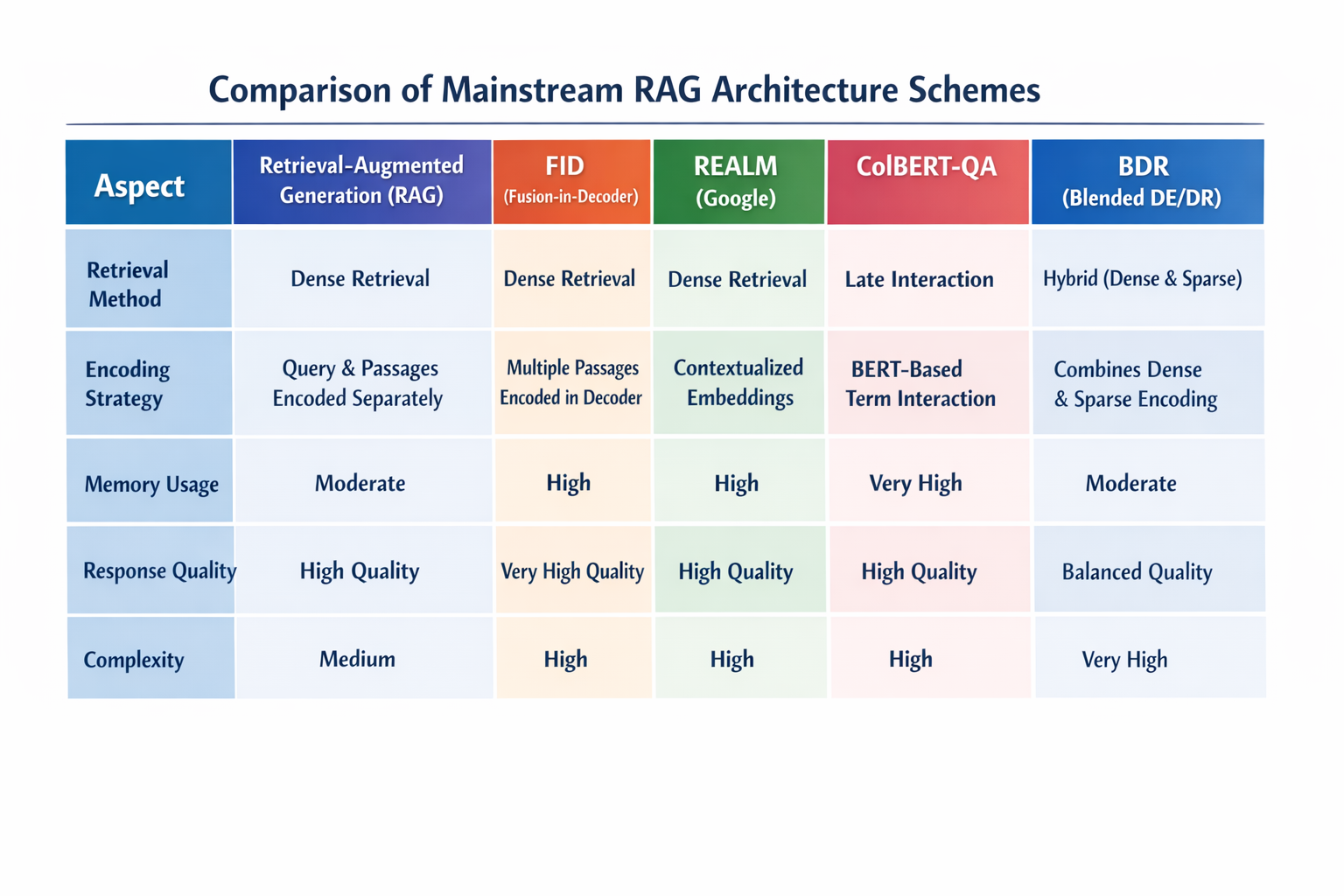

5种主流方案的差异,本质是“检索策略、文档处理方式、与大模型的融合度”三个维度的不同,我们从底层逻辑拆解,避免单纯记概念:

选型的核心不是“选方案”,而是“先定义场景指标,再匹配方案”。以下是可直接套用的实操框架,分“场景分析→指标评估→方案落地→调优迭代”四步:

先通过3个核心问题给场景定性:

示例:某创业公司内部文档中心,数据量3万条,并发20 QPS,核心诉求是“低成本快速落地”——定性为“轻量场景”,匹配基础RAG方案。

除了场景,还要评估4个关键指标,避免“过度设计”或“设计不足”:

核心组件:文档处理(LangChain)+ embedding模型(sentence-transformers)+ 轻量级向量库(Chroma)+ 大模型(ChatGLM-6B)

from langchain.text_splitter import RecursiveCharacterTextSplitter

# 初始化语义分片工具,按字符长度+语义边界拆分

text_splitter = RecursiveCharacterTextSplitter(

chunk_size=512, # 匹配embedding模型最大序列长度

chunk_overlap=50, # 重叠部分避免语义割裂

length_function=len,

separators=["\n\n", "\n", ". ", " ", ""] # 按优先级拆分(段落→句子→短语)

)

# 加载文档并分片

with open("personal_kb.txt", "r", encoding="utf-8") as f:

doc = f.read()

chunks = text_splitter.split_text(doc)

print(f"拆分后文档片段数:{len(chunks)}")

from langchain.embeddings import SentenceTransformerEmbeddings

from langchain.vectorstores import Chroma

# 初始化轻量embedding模型(平衡效果与速度)

embedding = SentenceTransformerEmbeddings(model_name="all-MiniLM-L6-v2")

# 初始化Chroma向量库(本地文件存储,无需部署服务)

db = Chroma.from_texts(

chunks,

embedding,

persist_directory="./chroma_db" # 本地存储路径

)

db.persist()

from langchain.chat_models import ChatGLM

from langchain.chains import RetrievalQA

# 初始化本地大模型(避免API调用成本)

llm = ChatGLM(endpoint_url="http://localhost:8000", max_token=2048, temperature=0.1)

# 构建检索链

qa_chain = RetrievalQA.from_chain_type(

llm=llm,

chain_type="stuff", # 简单拼接检索结果传给大模型

retriever=db.as_retriever(search_kwargs={"k": 3}), # 检索Top-3相关片段

return_source_documents=True # 返回来源文档,方便验证

)

# 测试提问

query = "我之前记录的Python爬虫代理池搭建步骤是什么?"

result = qa_chain({"query": query})

print(f"答案:{result['result']}")

print(f"来源文档:{[doc.page_content for doc in result['source_documents']]}")

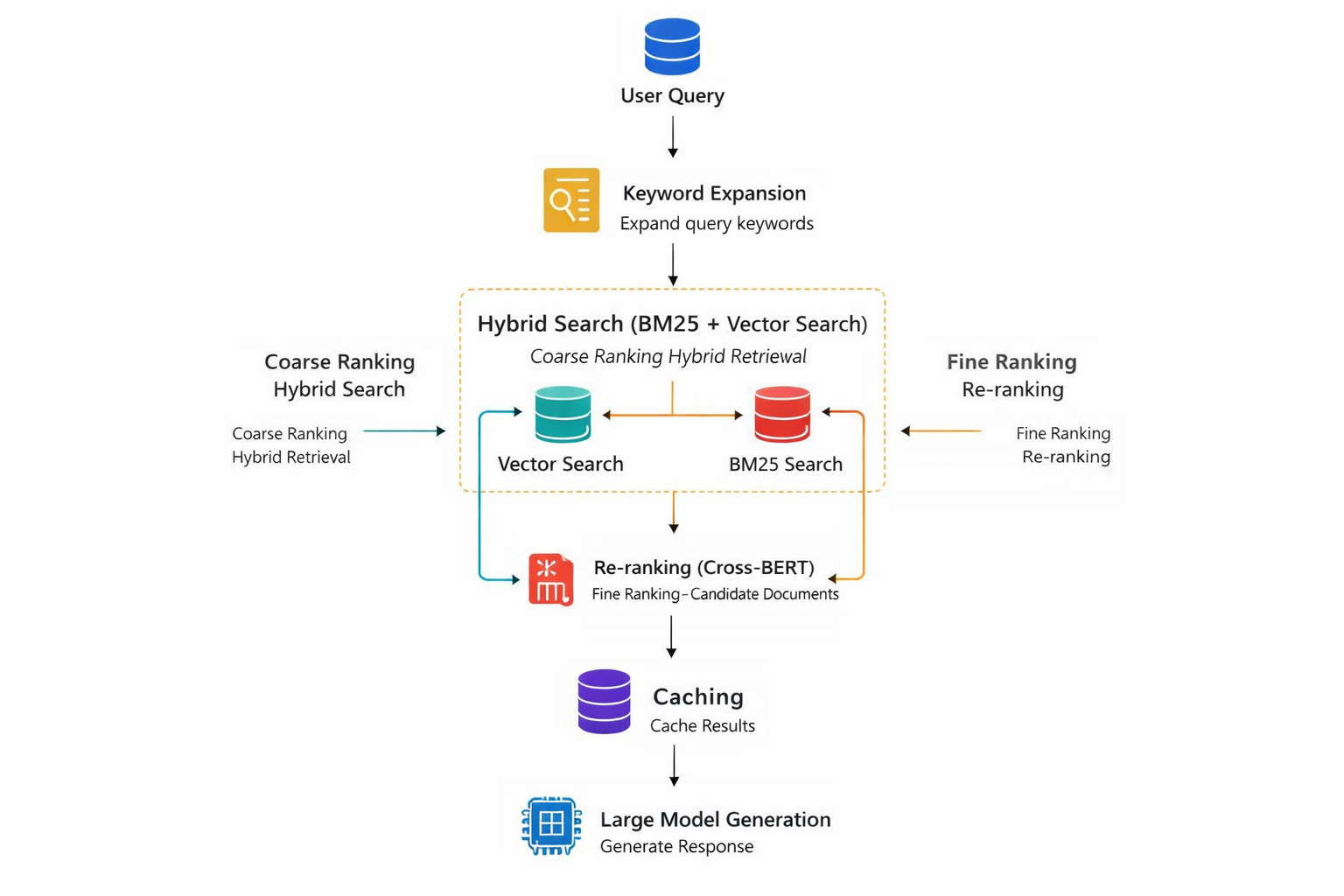

核心组件:文档处理(LangChain+LLM语义分片)+ 混合检索(Elasticsearch-BM25 + Milvus向量库)+ 检索重排(Cross-BERT)+ 大模型(GPT-4 Turbo)

import json

from langchain.text_splitter import SemanticChunker

from langchain.llms import OpenAI

# 用LLM做语义分片(精准匹配FAQ的问答逻辑,避免割裂)

llm = OpenAI(model_name="gpt-3.5-turbo", temperature=0)

text_splitter = SemanticChunker(llm=llm, chunk_size=1024)

# 加载电商FAQ文档(结构化格式:问题+答案)

with open("ecommerce_faq.json", "r", encoding="utf-8") as f:

faq_data = json.load(f)

docs = [f"问题:{item['question']}\n答案:{item['answer']}" for item in faq_data]

chunks = text_splitter.split_text("\n\n".join(docs))

# 1. Elasticsearch-BM25初始化(关键词检索)

from elasticsearch import Elasticsearch

es = Elasticsearch("http://localhost:9200")

# 创建索引并写入数据

index_name = "ecommerce_faq_bm25"

if not es.indices.exists(index=index_name):

es.indices.create(index=index_name)

for i, chunk in enumerate(chunks):

es.index(index=index_name, id=i, document={"content": chunk})

# 2. Milvus向量库初始化(语义检索,集群部署支持大规模数据)

from pymilvus import connections, Collection, FieldSchema, CollectionSchema, DataType

from langchain.embeddings import OpenAIEmbeddings

# 连接Milvus集群

connections.connect("default", host="localhost", port="19530")

# 定义Schema

fields = [

FieldSchema(name="id", dtype=DataType.INT64, is_primary=True, auto_id=True),

FieldSchema(name="embedding", dtype=DataType.FLOAT_VECTOR, dim=1536), # OpenAI embedding维度

FieldSchema(name="content", dtype=DataType.VARCHAR, max_length=2048)

]

schema = CollectionSchema(fields=fields, description="ecommerce faq collection")

collection = Collection(name="ecommerce_faq_vector", schema=schema)

# 创建索引(IVF_FLAT适合大规模数据精准检索)

index_params = {"metric_type": "L2", "index_type": "IVF_FLAT", "params": {"nlist": 1024}}

collection.create_index(field_name="embedding", index_params=index_params)

# 写入向量数据

embedding = OpenAIEmbeddings()

embeddings = embedding.embed_documents(chunks)

entities = [embeddings, chunks]

collection.insert(entities)

collection.load()

# 3. 混合检索逻辑(加权融合)

def hybrid_search(query, k=5):

# BM25检索

bm25_results = es.search(

index=index_name,

body={"query": {"match": {"content": query}}},

size=k

)

bm25_docs = [(hit["_source"]["content"], hit["_score"]) for hit in bm25_results["hits"]["hits"]]

# 向量检索

query_embedding = embedding.embed_query(query)

vector_results = collection.search(

data=[query_embedding],

anns_field="embedding",

param={"metric_type": "L2", "offset": 0, "limit": k},

output_fields=["content"]

)

# 归一化向量检索分数(转为0-1区间)

max_distance = max([res.distance for res in vector_results[0]]) if vector_results[0] else 1

vector_docs = [(res.entity.get("content"), 1 - res.distance/max_distance) for res in vector_results[0]]

# 加权融合(向量检索70%,BM25 30%)

combined = {}

for doc, score in bm25_docs:

combined[doc] = combined.get(doc, 0) + score * 0.3

for doc, score in vector_docs:

combined[doc] = combined.get(doc, 0) + score * 0.7

# 按分数排序,取Top-k

sorted_docs = sorted(combined.items(), key=lambda x: x[1], reverse=True)[:k]

return [doc for doc, score in sorted_docs]

from sentence_transformers import CrossEncoder

# 初始化重排模型(专门用于文本匹配排序)

cross_encoder = CrossEncoder('cross-encoder/ms-marco-MiniLM-L-6-v2', max_length=512)

def rerank_docs(query, docs, top_k=3):

# 构建(query, doc)匹配对

pairs = [(query, doc) for doc in docs]

# 计算相关性分数

scores = cross_encoder.predict(pairs)

# 按分数排序,取Top-k

sorted_pairs = sorted(zip(docs, scores), key=lambda x: x[1], reverse=True)

return [doc for doc, score in sorted_pairs[:top_k]]

# 完整检索流程:混合检索→重排

query = "如何申请退货退款?需要哪些材料?"

retrieved_docs = hybrid_search(query, k=5)

reranked_docs = rerank_docs(query, retrieved_docs, top_k=3)

from langchain.chains import RetrievalQA

from langchain.cache import RedisCache

import redis

from langchain.llms import OpenAI

# 缓存优化(减少重复检索,提升并发)

redis_client = redis.Redis(host='localhost', port=6379, db=0)

langchain.llm_cache = RedisCache(redis_client)

# 初始化大模型

llm = OpenAI(model_name="gpt-4-turbo", temperature=0.1)

# 构建生成链(refine模式优化答案质量)

qa_chain = RetrievalQA.from_chain_type(

llm=llm,

chain_type="refine",

retriever=lambda q: rerank_docs(q, hybrid_search(q, k=5), top_k=3),

return_source_documents=True

)

# 测试大规模并发(可通过Locust模拟500 QPS)

result = qa_chain({"query": query})

print(f"答案:{result['result']}")

如果觉得大规模场景的底层架构搭建(混合检索引擎、重排模块、集群部署)过于繁琐,可选择支持“一键部署增强RAG+混合检索”的在线平台,比如LLaMA-Factory online。它内置了Elasticsearch+Milvus混合检索、Cross-BERT重排、Redis缓存优化等核心模块,无需手动配置集群和调优参数,只需上传文档即可快速实现1000万条数据的RAG部署,P99响应时间稳定在500ms内,大幅降低大规模RAG的落地成本。

选型落地后,需要从4个核心指标验证效果,避免“上线后才发现不达标”:

如果某指标不达标,按以下方向优化:

RAG选型的核心逻辑可以总结为“三看”:看数据量、看并发量、看核心诉求——轻量场景选基础RAG,追求“低成本快速落地”;中大规模场景选增强RAG+混合检索,追求“高召回率+低延迟”;多模态场景选多模态RAG,追求“全类型知识覆盖”;高精度场景选RAG+微调混合方案,追求“极致准确率”。

回顾RAG技术的发展,从早期的基础方案到如今的增强RAG、多模态RAG,核心趋势是“更精准、更高效、更易用”——未来,RAG会与大模型深度融合(大模型内置检索能力,无需额外部署检索引擎)、隐私保护更完善(支持本地私有化部署+端到端加密)、自适应场景更智能(自动根据数据量和并发量调整架构)。

对于技术人员来说,选型的本质不是“追新”,而是“适配”——不需要盲目跟风复杂方案,也不能用轻量方案硬扛大规模场景。关键是掌握“场景-指标-方案”的匹配逻辑,同时善用成熟工具和平台,降低落地成本。

对于需要快速迭代不同RAG方案的团队(比如从轻量场景扩展到大规模场景,或从纯文本扩展到多模态),推荐选择支持“5种主流方案快速切换”的在线平台,LLaMA-Factory online能适配从1000条到1000万条数据的全场景,支持基础RAG、增强RAG、混合检索等方案的一键切换,无需重构底层架构,同时提供完整的效果评估工具(召回率测试、响应时间监控),帮助技术人员快速验证选型效果,加速RAG的落地与迭代。

最后,RAG选型没有“一劳永逸”的方案,需要根据业务发展持续优化——比如随着数据量增长,从基础RAG升级为增强RAG;随着用户需求变化,从纯文本RAG扩展为多模态RAG。希望这篇文章的选型框架和实操步骤,能帮你避开90%的坑,精准匹配适合自己场景的RAG方案。