时间:2025-04-30 17:24

人气:

作者:admin

作者:肯梦、折原

Qwen3 正式发布并全部开源8款「混合推理模型」。凭借其卓越的性能和广泛的应用场景,迅速在全球范围内获得了极高的关注度和广泛的用户基础。

此次开源包括 两款 MoE 模型:Qwen3-235B-A22B(2350多亿总参数、 220多亿激活参),以及 Qwen3-30B-A3B(300亿总参数、30亿激活参数);以及 六个 Dense 模型:Qwen3-32B、Qwen3-14B、Qwen3-8B、Qwen3-4B、Qwen3-1.7B 和 Qwen3-0.6B。

这些模型在代码、数学、通用能力等基准测试中表现出极具竞争力的结果。Qwen3 支持思考模式和非思考模式两种思考模式,适用于不同类型的问题,支持119种语言和方言。

依托于阿里云 函数计算 FC 算力,Serverless+ AI 开发平台 FunctionAI 现已提供模型服务、应用模版两种部署方式辅助您部署 Qwen3 系列模型。 完成模型部署后,您即可与模型进行对话体验;或以 API 形式进行调用,接入 AI 应用中,欢迎您立即体验。

部署方式说明:

vLLM:大模型加速推理框架,优化内存利用率和吞吐量,适合高并发场景。

SGLang:支持复杂的 LLM Programs,如多轮对话、规划、工具调用和结构化输出等,并通过协同设计前端语言和后端运行时,提升多 GPU 节点的灵活性和性能。

| 模型 | 部署方式 | 最低配置 |

|---|---|---|

| 通义千问3-0.6B | vLLM/SGLang/Ollama | GPU 进阶型 |

| 通义千问3-0.6B-FP8 | vLLM/SGLang/Ollama | GPU 进阶型 |

| 通义千问3-1.7B | vLLM/SGLang/Ollama | GPU 进阶型 |

| 通义千问3-1.7B-FP8 | vLLM/SGLang/Ollama | GPU 进阶型 |

| 通义千问3-4B | vLLM/SGLang/Ollama | GPU 进阶型 |

| 通义千问3-4B-FP8 | vLLM/SGLang/Ollama | GPU 进阶型 |

| 通义千问3-8B | vLLM/SGLang/Ollama | GPU 性能型 |

| 通义千问3-8B-FP8 | vLLM/SGLang/Ollama | GPU 性能型 |

| 通义千问3-14B | vLLM/SGLang/Ollama | GPU 性能型 |

| 通义千问3-14B-FP8 | vLLM/SGLang/Ollama | GPU 性能型 |

本篇文档将以 通义千问 3-8B 模型演示部署流程。

实现 通义千问 3-8B 模型 + OpenWebUI 部署

点击如下链接新建项目:

https://cap.console.aliyun.com/projects

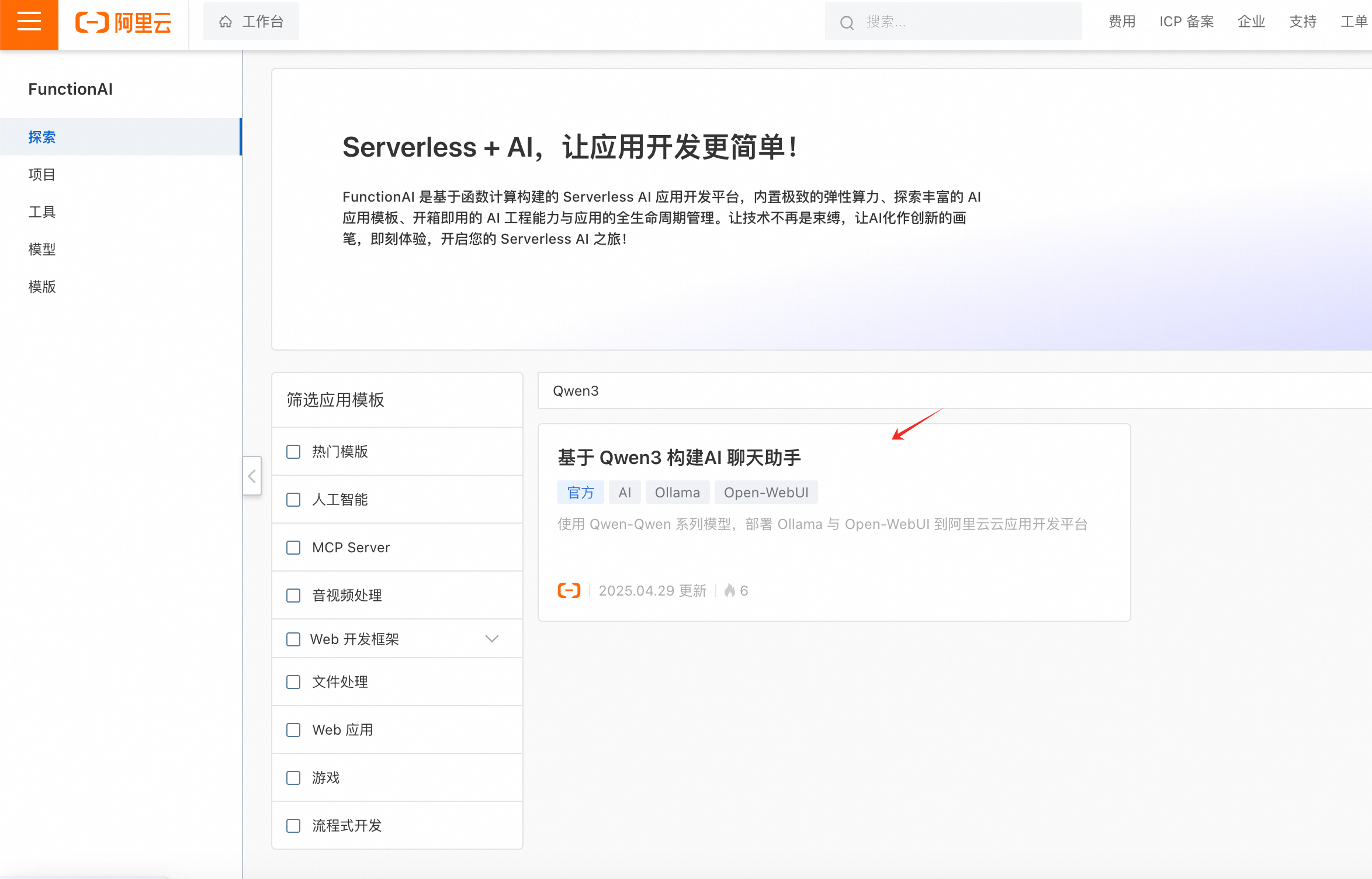

搜索 “Qwen3” ,点击 “基于 Qwen3 构建 AI 聊天助手” 模版并部署

选择 Region 并部署应用

部署过程大约持续 10 分钟左右

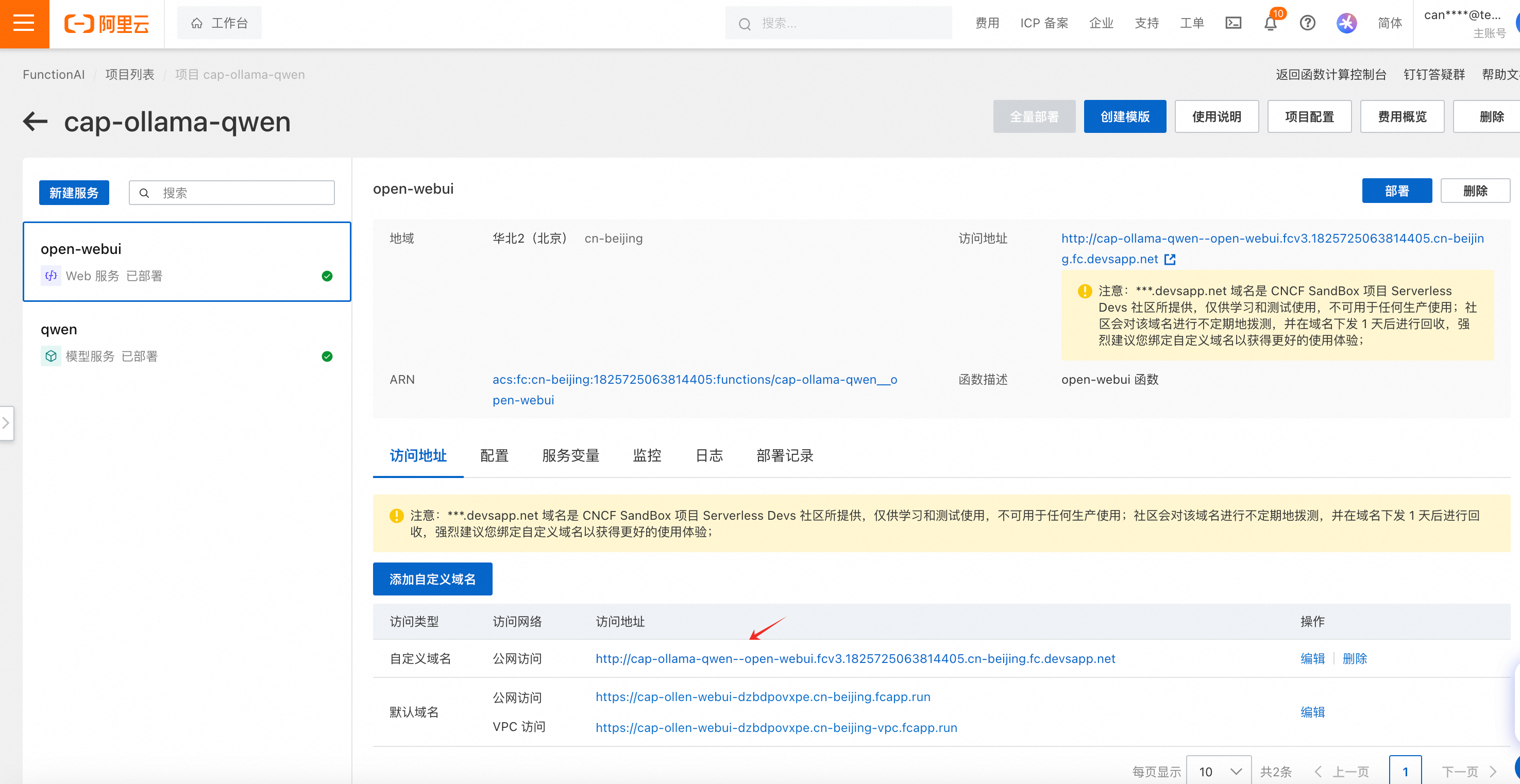

部署完毕后,点击 OpenWebUI 服务,在访问地址内找到“公网访问”

在 OpenWebUI 界面验证 qwen 模型对话

云应用开发平台 FunctionAI 是阿里云推出的一站式应用开发和生命周期管理平台。 应用开发者可以通过 Serverless 架构来构建容器化、高弹性、免运维的云上应用,也可以通过 AI 大语言模型推动云上应用逐步升级为智能化应用,而 FunctionAI 的应用开发范式正是结合了 Serverless 和 AI 的两者优势,帮助开发者更高效地响应市场变化,快速构建高可用、低延迟的云上应用。

FunctionAI 提供了丰富的 Serverless +AI 应用模板、先进的开发工具和企业级应用管理功能,帮助个人和企业开发者专注于业务场景,快速构建并持续迭代云上应用,可显著提高研发、部署和运维效率。

云应用开发平台 FunctionAI 具备极速体验、生态集成、更低成本以及灵活组装等特点,Serverless 与 AI 紧密结合,让存量应用智能化更便捷、让 AI 应用开发更简单。

推荐您在 PC端体验:https://www.aliyun.com/product/cap

更多内容关注 Serverless 微信公众号(ID:serverlessdevs),汇集 Serverless 技术最全内容,定期举办 Serverless 活动、直播,用户最佳实践。