时间:2026-03-10 09:42

人气:

作者:admin

实际项目请根据侧边目录手动跳转至实际项目部分,本项目实践学习及来源于

Building Low Latency Applications with C++.pdf

部分基础知识来源:

https://weedge.github.io/perf-book-cn/zh/,

https://arxiv.org/abs/2309.04259

项目代码地址:https://github.com/zzxscodes/zquant-system

isolcpus:内核启动参数CPU隔离

编辑 /etc/default/grub 。

修改 GRUB_CMDLINE_LINUX_DEFAULT 这一行, 在引号内添加 isolcpus=cpu号列表 (例如: isolcpus=2,3 isolcpus=1,4-7)。

执行 sudo update-grub (Debian/Ubuntu) ( sudo grub2-mkconfig -o /boot/grub2/grub.cfg(RHEL/CentOS/Fedora)) 并 sudo reboot。

taskset:命令行工具CPU绑定

启动进程: taskset -c 1 ./my_app (在CPU 1上运行)

修改运行中进程:taskset -pc 3 <PID> (将PID进程移至CPU 3)

查询进程:taskset -pc <PID>

绑定进程下的线程: ps -T -p <PID> taskset -p -c <CPU列表> <TID>

pthread_setaffinity_np(sched_setaffinity):线程(进程)CPU绑定

#pragma once

#include <iostream>

#include <atomic>

#include <thread>

#include <unistd.h>

#include <sys/syscall.h>

namespace Common {

/// Set affinity for current thread to be pinned to the provided core_id.

inline auto setThreadCore(int core_id) noexcept {

cpu_set_t cpuset;

CPU_ZERO(&cpuset);

CPU_SET(core_id, &cpuset);

return (pthread_setaffinity_np(pthread_self(), sizeof(cpu_set_t), &cpuset) == 0);

}

/// Creates a thread instance, sets affinity on it, assigns it a name and

/// passes the function to be run on that thread as well as the arguments to the function.

template<typename T, typename... A>

inline auto createAndStartThread(int core_id, const std::string &name, T &&func, A &&... args) noexcept {

auto t = new std::thread([&]() {

if (core_id >= 0 && !setThreadCore(core_id)) {

std::cerr << "Failed to set core affinity for " << name << " " << pthread_self() << " to " << core_id << std::endl;

exit(EXIT_FAILURE);

}

std::cerr << "Set core affinity for " << name << " " << pthread_self() << " to " << core_id << std::endl;

std::forward<T>(func)((std::forward<A>(args))...);

});

using namespace std::literals::chrono_literals;

std::this_thread::sleep_for(1s);

return t;

}

}

/*

* sched_setaffinity 和 pthread_setaffinity_np 的区别:

*

* 1. 作用对象:

* - pthread_setaffinity_np: 作用线程,通过 pthread_t 句柄来指定要绑定的线程。

* - sched_setaffinity: 作用进程。它通过进程ID (PID) 来指定要绑定的进程。

* 一个进程被绑定,所有子线程也会被限制在这个CPU中。

* 2. 可移植性:

* - pthread_setaffinity_np: GNU C 库(glibc)扩展。

* - sched_setaffinity: 标准 Linux 系统调用。

*/

cpusets:CPU资源池隔离

#!/usr/bin/env bash

#

# simple_cpuset_example.sh

#

# 演示如何使用 cpuset 将一个任务绑定到专属的 CPU 核心。

# --- 配置 ---

# 为后台任务分配的常规核心

SYSTEM_CORE="0"

# 为专属任务保留的核心

EXCLUSIVE_CORE="1"

set -e

# 确保脚本以 root 权限运行

if [[ $(id -u) -ne 0 ]]; then

echo "此脚本必须以 root 身份运行。"

exit 1

fi

# 1. 创建 cgroup 目录

echo "--> 正在创建 cpuset 核心池..."

mkdir -p /sys/fs/cgroup/cpuset/exclusive_tasks

# 2. 配置独占核心池

# 将核心 1 分配给这个池

echo "${EXCLUSIVE_CORE}" > /sys/fs/cgroup/cpuset/exclusive_tasks/cpuset.cpus

# 将其标记为 CPU 独占

echo "1" > /sys/fs/cgroup/cpuset/exclusive_tasks/cpuset.cpu_exclusive

# 将内存节点 0 分配给这个池(通常一个核心只有一个内存节点)

echo "0" > /sys/fs/cgroup/cpuset/exclusive_tasks/cpuset.mems

# 3. 运行一个任务并将其绑定到独占核心池

echo "--> 正在启动一个无限循环并绑定到核心 ${EXCLUSIVE_CORE}..."

# 启动一个后台任务

while true; do :; done &

TASK_PID=$!

echo "任务 PID: ${TASK_PID}"

# 将任务的 PID 写入独占池的 tasks 文件中

echo "${TASK_PID}" > /sys/fs/cgroup/cpuset/exclusive_tasks/tasks

echo "任务已成功绑定。可以使用 'top' 或 'htop' 检查 PID ${TASK_PID} 是否正在核心 ${EXCLUSIVE_CORE} 上运行。"

echo "要停止任务,请运行:kill ${TASK_PID}"

| 特性 | isolcpus | cpusets | taskset | pthread_setaffinity_np |

|---|---|---|---|---|

| 层级 | 内核级 | 内核级 | 进程级 | 线程级 |

| 方式 | 启动参数 | 虚拟文件系统接口 | 命令行 | 库函数 |

| 隔离强度 | 强 | 强 | 弱 | 弱 |

| 粒度 | CPU | CPU & 内存节点池 | 进程 | 线程 |

| 动态性 | 静态 (需重启) | 动态 | 动态 | 动态 |

CPU的超线程技术(HT)将物理核模拟为两个逻辑核,共享核心的执行单元(如ALU、FPU)和L1/L2缓存。

(1)若绑定到同一物理核上的线程执行计算密集型操作,尤其是AVX等宽指令集,会完全占用共享的浮点单元,导致交易线程阻塞;

(2)线程对L1/L2缓存的访问会污染或驱逐交易线程的热点数据,增加缓存未命中。

(3)禁用超线程可使关键交易线程的执行延迟更低,降低延迟波动。

(4)禁用超线程会降低系统的整体吞吐量。因此将低延迟敏感任务独占绑定到物理核心(逻辑核ID的偶数或奇数部分),而将非实时性任务部署在启用超线程的核心上。(Linux系统层面实现)

lscpu -e # 假设输出显示 CPU 0 和 CPU 8 都属于 CORE 0。这意味着它们是同一个物理核心上的两个“兄弟”逻辑核心。

# 查看 CPU 8 的在线状态 (1 代表在线)

cat /sys/devices/system/cpu/cpu8/online

# 将 CPU 8 设置为离线 (禁用)

echo 0 > /sys/devices/system/cpu/cpu8/online

# 查看在线的CPU数量,会比原来少1

nproc

# 或者再次运行 lscpu,会看到 CPU 8 显示为 no (离线)

lscpu -e | grep "cpu8"

# 此时,操作系统调度器不会再向 CPU 8 分配任何任务。CPU 0 现在可以不受干扰地使用物理核心 0 的全部资源。

#重启只需

echo 1 > /sys/devices/system/cpu/cpu8/online

# 清晰地列出CPU、核心、Socket的对应关系

lscpu -e=CPU,CORE,SOCKET

# 绑定策略进程到物理核8-15(跳过超线程核)

taskset -c 8-15 ./strategy_engine

关闭 CPU 节能(C-States & P-States)

BIOS/UEFI 层面

| BIOS 设置项 | 推荐值 | 说明 |

|---|---|---|

| CPU C-States / Global C-State Control | Disabled |

禁用所有 C-State(C1~C10),CPU 永不进入休眠 |

| C1E Support | Disabled |

禁用增强型 C1 状态(即使 C-States 关闭,C1E 仍可能启用) |

| Intel SpeedStep (EIST) / AMD Cool'n'Quiet | Disabled |

禁用 P-State 动态调频,锁定频率 |

| Intel Turbo Boost / AMD Core Performance Boost | Disabled |

禁用自动超频,避免频率波动 |

| CPU Ratio / Multiplier | 固定值(如 45) |

手动设置 CPU 倍频,实现频率锁定(需同步禁用 SpeedStep) |

| Hyper-Threading / SMT Mode | Disabled |

可选:关闭超线程,减少调度干扰,便于精准控制。全局开关,会使精准控制超线程核策略失效 |

| Power Technology (AMD) | Custom→ 手动关闭各项节能 |

AMD 平台注意项 |

Linux 内核参数

sudo vim /etc/default/grub

GRUB_CMDLINE_LINUX_DEFAULT="quiet splash \

intel_idle.max_cstate=0 \

processor.max_cstate=1 \

idle=poll \

intel_pstate=disable"

| 参数 | 作用 |

|---|---|

intel_idle.max_cstate=0 |

强制 Intel CPU 的 intel_idle驱动禁用所有 C-State(C1 及以上) |

processor.max_cstate=1 |

兼容备用驱动(acpi-cpufreq),限制最大 C-State 为 C1 |

idle=poll |

最激进设置:空闲时 CPU 不等待中断,而是持续轮询任务队列,实现最低延迟(但功耗极高) |

intel_pstate=disable |

禁用现代 Intel P-State 驱动,回退到传统 acpi-cpufreq,便于手动控制频率 |

# Debian/Ubuntu

sudo update-grub

# CentOS/RHEL/Fedora

sudo grub2-mkconfig -o /boot/grub2/grub.cfg

sudo reboot

Linux 运行时控制

# Ubuntu/Debian

sudo apt install cpufrequtils linux-tools-common

# CentOS/RHEL

sudo yum install cpufreq-utils kernel-tools

# Fedora

sudo dnf install kernel-tools

cpupower frequency-info

输出关键信息:

driver: 当前使用的驱动(intel_pstate, acpi-cpufreq)governor: 当前调频策略(powersave, performance, userspace)current policy: 支持的频率范围sudo cpupower frequency-set -g performance

performance 模式会尽可能保持最高频率(P0 State)# 锁定所有 CPU 到 3.5GHz

sudo cpupower frequency-set -f 3500MHz

# 或设置最小/最大频率范围

sudo cpupower frequency-set -d 3500MHz -u 3500MHz

sudo vim /etc/systemd/system/cpu-performance.service

[Unit]

Description=Set CPU to Performance Mode

After=multi-user.target

[Service]

Type=oneshot

ExecStart=/usr/bin/cpupower frequency-set -g performance

RemainAfterExit=yes

[Install]

WantedBy=multi-user.target

sudo systemctl enable cpu-performance.service

sudo systemctl start cpu-performance.service

验证节能是否已关闭

# 查看当前空闲状态

cat /proc/cpuinfo | grep -i "idle"

# 使用 turbostat(需 root)

sudo turbostat --interval 5

C0% 是否接近 100%,其他 C-state(C1~C10)应为 0%Busy% 应 ≈ C0%watch -n 0.5 'cat /proc/cpuinfo | grep "cpu MHz"'

cpupower frequency-info

governor 应为 performancecurrent policy 频率范围应窄或固定替代方案

| 方法 | 最激进用法 | 作用说明 |

|---|---|---|

x86_energy_perf_policy |

sudo x86_energy_perf_policy performance |

强制所有 CPU 核心运行在最高性能模式,禁用动态调频节能 |

isolcpus + nohz_full + rcu_nocbs |

内核参数: isolcpus=2-7 nohz_full=2-7 rcu_nocbs=2-7 |

将 CPU 2-7 完全隔离,无定时中断、无内核调度干扰,专用于实时任务 |

tuned服务 |

sudo tuned-adm profile latency-performance |

启用极致低延迟配置,关闭节能,优化调度与中断处理 |

powertop --auto-tune |

sudo powertop --auto-tune |

自动将所有子系统(CPU、磁盘、USB 等)设为高性能模式,适合性能压测 |

系统的NUMA拓扑

常用工具来查看NUMA拓扑:

numactl --hardware:显示NUMA节点的硬件信息,包括CPU数量和内存大小。lscpu:显示CPU架构信息,包括NUMA节点分布。hwloc:一个库和工具集,可以生成系统的详细拓扑图,包括NUMA节点、CPU、缓存、PCI设备等。# numactl --hardware

available: 2 nodes (0-1)

node 0 cpus: 0 1 2 3 4 5 6 7 8 9 10 11 12 13 14 15 16 17 18 19 20 21 22 23 48 49 50 51 52 53 54 55 56 57 58 59 60 61 62 63 64 65 66 67 68 69 70 71

node 0 size: 96920 MB

node 0 free: 2951 MB

node 1 cpus: 24 25 26 27 28 29 30 31 32 33 34 35 36 37 38 39 40 41 42 43 44 45 46 47 72 73 74 75 76 77 78 79 80 81 82 83 84 85 86 87 88 89 90 91 92 93 94 95

node 1 size: 98304 MB

node 1 free: 33 MB

node distances:

node 0 1

0: 10 21

1: 21 10

# numactl --show

policy: default

preferred node: current

physcpubind: 0 1 2 3 4 5 6 7 8 9 10 11 12 13 14 15 16 17 18 19 20 21 22 23 24 25 26 27 28 29 30 31 32 33 34 35 36 37 38 39 40 41 42 43 44 45 46 47 48 49 50 51 52 53 54 55 56 57 58 59 60 61 62 63 64 65 66 67 68 69 70 71 72 73 74 75 76 77 78 79 80 81 82 83 84 85 86 87 88 89 90 91 92 93 94 95

cpubind: 0 1

nodebind: 0 1

membind: 0 1

numactl 命令还有几个重要选项:

<font style="color:rgb(25, 27, 31);background-color:rgb(248, 248, 250);">--cpubind=0</font>: 绑定到 node 0 的 CPU 上执行。<font style="color:rgb(25, 27, 31);background-color:rgb(248, 248, 250);">--membind=1</font>: 只在 node 1 上分配内存。<font style="color:rgb(25, 27, 31);background-color:rgb(248, 248, 250);">--interleave=nodes</font>:nodes 可以是 all、N,N,N 或 N-N,表示在 nodes 上轮循(round robin)分配内存。<font style="color:rgb(25, 27, 31);background-color:rgb(248, 248, 250);">--physcpubind=cpus</font>:cpus 是 /proc/cpuinfo 中的 processor(超线程) 字段,cpus 的格式与 --interleave=nodes 一样,表示绑定到 cpus 上运行。<font style="color:rgb(25, 27, 31);background-color:rgb(248, 248, 250);">--preferred=1</font>: 优先考虑从 node 1 上分配内存。numactl 命令的几个例子:

# 运行 test_program 程序,参数是 argument,绑定到 node 0 的 CPU 和 node 1 的内存

numactl --cpubind=0 --membind=1 test_program arguments

# 在 processor 0-4,8-12 上运行 test_program

numactl --physcpubind=0-4,8-12 test_program arguments

# 轮询分配内存,将程序的内存页交错分配到所有 NUMA 节点,同时允许程序在所有 CPU 上运行。适用于对内存带宽要求高,数据访问模式随机的应用。

numactl --interleave=all test_program arguments

# 优先考虑从 node 1 上分配内存

numactl --preferred=1

1. 核心思想

在多CPU插槽的服务器上,每个CPU都有自己的本地内存,访问本地内存的速度远快于访问另一个CPU的内存(远程内存)。因此,优化的关键是确保“谁计算,谁的数据就在谁身边”。

高级场景(高性能网络)是cpu、内存、PCIe 设备(网卡)的一致。

2. Linux的内存分配行为

vm.zone_reclaim_mode 决定。

vm.zone_reclaim_mode = 0 (默认值): 本地内存不足时,去远程节点寻找空闲内存,是大多数场景的推荐配置。vm.zone_reclaim_mode = 1: 本地内存不足时,优先回收本地不活跃的内存页(如Cache),而不是去访问远程内存。这个回收过程本身可能引入延迟。3. 管理与优化工具

**numactl**** (最常用)**: 命令行工具,在启动应用时指定其NUMA策略。

**--membind**): numactl --cpunodebind=0 --membind=0 my_app

my_app 只能在节点0的CPU上运行,且只能从节点0的内存分配。如果节点0内存耗尽,分配会失败。提供最强的性能确定性。**--preferred**): numactl --preferred=0 my_app

**sysctl**** (系统级调整)**:

sudo sysctl -w vm.zone_reclaim_mode=0: 确保系统采用默认的NUMA分配行为,避免不必要的本地内存回收延迟。# 永久修改

# 在 /etc/sysctl.conf 或 /etc/sysctl.d/下的新文件中添加一行:

# vm.zone_reclaim_mode = 0

# 然后执行 sudo sysctl -p 使其生效

**cpuset**** (底层硬隔离)**:

cpuset 在分配CPU核心的同时,通过 cpuset.mems 文件也强制绑定了内存节点,是比 numactl 更底层的内核级隔离,效果与 numactl --membind 类似但隔离性更强。4.NUMA之前

NUMA优化是一个迭代的过程,需要持续的性能分析和监控来识别瓶颈并验证优化效果。

**numastat**: 实时或历史地查看每个 NUMA 节点的内存访问统计,包括本地(local_node)和远程(other_node)内存访问次数。如果远程访问比例很高,说明 NUMA 优化还有空间。$ numastat -m # 查看内存策略

$ numastat -c # 查看每个CPU的内存访问统计

$ numastat -p <pid> # 查看特定进程的NUMA统计

**perf**: Linux 下性能分析工具,可以跟踪各种硬件事件,例如缓存未命中(cache-misses)、远程内存访问(mem_load_retired.l3_miss 等)。通过分析这些事件发现潜在的 NUMA 瓶颈。$ perf stat -e cache-misses,L1-dcache-loads,L1-dcache-misses ./your_program

考虑因素:

显式 NUMA 感知内存分配

以下是 libnuma 常用接口及相关系统调用表:

| 分类 | 函数签名 | 返回值类型 | 关键说明 |

|---|---|---|---|

| 初始化与版本 | void numa_available(void); |

void |

检查 NUMA 支持,不支持则终止程序 |

const char *numa_version(void); |

const char * |

返回库版本字符串(如libnuma 2.0.14) |

|

| 节点信息查询 | int numa_max_node(void); |

int |

返回最大节点编号(从 0 开始,无节点返回 - 1) |

int numa_num_configured_nodes(void); |

int |

返回配置的节点总数 | |

extern struct bitmask *numa_all_nodes_ptr; |

全局变量 | 包含所有可用节点的预定义位掩码 | |

extern struct bitmask *numa_nodes_ptr; |

全局变量 | 当前进程可访问的节点位掩码 | |

| 内存分配 | void *numa_alloc_onnode(size_t size, int node); |

void * |

在指定节点分配内存,失败返回NULL |

void *numa_alloc_local(size_t size); |

void * |

在本地节点分配内存,失败返回NULL |

|

void *numa_alloc_interleaved(size_t size); |

void * |

交叉分配内存到所有节点,失败返回NULL |

|

void numa_free(void *ptr, size_t size); |

void |

释放numa_alloc_*分配的内存(需指定大小) |

|

void *numa_realloc(void *oldptr, size_t oldsize, size_t newsize); |

void * |

重新分配内存并保持节点亲和性,失败返回NULL |

|

| 内存策略设置 | void numa_set_localalloc(void); |

void |

设置默认策略为 “本地节点优先” |

void numa_set_interleave_mask(const struct bitmask *mask); |

void |

按mask节点集设置交叉分配模式 |

|

void numa_set_bind_mask(const struct bitmask *mask); |

void |

限制内存分配到mask指定节点 |

|

void numa_set_preferred(int node); |

void |

设置内存分配的首选节点 | |

| 进程亲和性 | int numa_run_on_node(int node); |

int |

绑定当前进程到节点node的 CPU,成功返回 0,失败返回 - 1 |

int numa_run_on_node_mask(const struct bitmask *mask); |

int |

绑定当前进程到mask节点集的 CPU,成功返回 0,失败返回 - 1 |

|

int numa_sched_setaffinity(pid_t pid, const struct bitmask *mask); |

int |

设置进程pid的 CPU 亲和性为mask节点,成功返回 0,失败返回 - 1 |

|

| 节点属性查询 | long long numa_node_size64(int node, int *free); |

long long |

返回节点总内存(字节),free输出空闲内存(KB),失败返回 - 1 |

int numa_node_of_cpu(int cpu); |

int |

返回 CPUcpu所属节点,失败返回 - 1 |

|

| 位掩码操作 | struct bitmask *numa_bitmask_alloc(unsigned int nbits); |

struct bitmask * |

分配容纳nbits位的位掩码,失败返回NULL |

void numa_bitmask_free(struct bitmask *b); |

void |

释放位掩码b(b为NULL时无操作) |

|

void numa_bitmask_setall(struct bitmask *b); |

void |

设置b的所有位(包含所有节点) |

|

void numa_bitmask_clearall(struct bitmask *b); |

void |

清空b的所有位(不包含任何节点) |

|

void numa_bitmask_setbit(struct bitmask *b, unsigned int i); |

void |

设置b的第i位(包含节点i) |

|

void numa_bitmask_clearbit(struct bitmask *b, unsigned int i); |

void |

清除b的第i位(不包含节点i) |

|

int numa_bitmask_is_set(const struct bitmask *b, unsigned int i); |

int |

检查b的第i位是否设置,是返回 1,否则返回 0 |

|

struct bitmask *numa_allocate_nodemask(void); |

struct bitmask * |

分配默认大小的节点位掩码(等价于numa_bitmask_alloc(numa_max_node()+1)) |

|

void numa_free_nodemask(struct bitmask *b); |

void |

释放numa_allocate_nodemask分配的位掩码 |

|

| 大页 + NUMA 相关系统调用 | void *mmap(void *addr, size_t length, int prot, int flags, int fd, off_t offset); |

void * |

分配内存(MAP_HUGETLB标志用于大页),失败返回MAP_FAILED |

int mbind(void *start, size_t length, int policy, const unsigned long *nmask, unsigned int maxnode, unsigned int flags); |

int |

为内存块设置 NUMA 策略(如MPOL_BIND),成功返回 0,失败返回 -1 |

示例:在特定节点上分配内存

#define _GNU_SOURCE // 启用 GNU 扩展,包括 sched_setaffinity

#include <pthread.h>

#include <sched.h>

#include <iostream>

#include <thread>

#include <vector>

#include <numa.h> // 需要链接 libnuma

void worker_function(int thread_id, int target_cpu) {

cpu_set_t cpuset;

CPU_ZERO(&cpuset);

CPU_SET(target_cpu, &cpuset);

if (pthread_setaffinity_np(pthread_self(), sizeof(cpu_set_t), &cpuset) != 0) {

std::cerr << "Error setting CPU affinity for thread " << thread_id << " to CPU " << target_cpu << std::endl;

} else {

std::cout << "Thread " << thread_id << " bound to CPU " << target_cpu << std::endl;

}

// 模拟一些工作,例如访问之前分配在特定NUMA节点上的数据

long long sum = 0;

for (int i = 0; i < 100000000; ++i) {

sum += i;

}

std::cout << "Thread " << thread_id << " finished work, sum: " << sum << std::endl;

}

int main() {

if (numa_available() == -1) {

std::cerr << "NUMA support not available." << std::endl;

return 1;

}

int num_nodes = numa_num_configured_nodes();

if (num_nodes < 1) {

std::cerr << "No NUMA nodes detected." << std::endl;

return 1;

}

std::vector<std::thread> threads;

int current_cpu = 0;

for (int i = 0; i < num_nodes; ++i) {

// 获取当前NUMA节点上的所有CPU

struct bitmask *cpus_on_node = numa_node_to_cpus(i);

if (cpus_on_node == nullptr) {

std::cerr << "Failed to get CPUs for node " << i << std::endl;

continue;

}

// 遍历该节点上的所有CPU,并为每个CPU创建一个线程

for (int cpu = 0; cpu <= cpus_on_node->size; ++cpu) {

if (numa_bitmask_isbitset(cpus_on_node, cpu)) {

threads.emplace_back(worker_function, current_cpu, cpu);

current_cpu++;

}

}

numa_free_cpumask(cpus_on_node);

}

for (auto& t : threads) {

t.join();

}

std::cout << "All threads finished." << std::endl;

return 0;

}

编译:g++ -std=c++11 test.cpp -o test -lnuma -pthread

运行:./test

NUMA数据分片

数据分片的核心思想是根据数据的访问频率、重要性以及策略逻辑,将不同类型的数据结构分配到最合适的物理内存区域。

# 查看NUMA节点分布

numactl --hardware

# 为Node0分配1024个2MB大页

echo 1024 > /sys/devices/system/node/node0/hugepages/hugepages-2048kB/nr_hugepages

# 为Node1分配512个1GB大页(若支持)

echo 512 > /sys/devices/system/node/node1/hugepages/hugepages-1048576kB/nr_hugepages

#include <numa.h>

#include <numaif.h>

#include <sys/mman.h>

void* alloc_hugepage_on_node(int node, size_t size) {

struct bitmask *nm = numa_allocate_nodemask();

if (!nm) return NULL;

numa_bitmask_setbit(nm, node);

void* ptr = mmap(NULL, size, PROT_READ|PROT_WRITE,

MAP_PRIVATE|MAP_ANONYMOUS|MAP_HUGETLB, -1, 0);

if (ptr == MAP_FAILED) {

perror("mmap hugepage failed");

numa_free_nodemask(nm);

return NULL;

}

if (mbind(ptr, size, MPOL_BIND, nm->maskp, nm->size + 1, 0) == -1) {

perror("mbind failed");

munmap(ptr, size); // 绑定失败需释放已分配的大页

numa_free_nodemask(nm);

return NULL;

}

numa_free_nodemask(nm);

return ptr;

}

int main() {

const size_t memSize = 2 * 1024 * 1024; // 2MB

void* lockMem = alloc_hugepage_on_node(0, memSize);

// 锁定内存

if (-1 == mlock(lockMem, memSize)) {

munmap(lockMem, memSize);

}

// 手动触发缺页中断

memset(lockMem, 0, memSize);

// 保持常驻(程序运行时内存不会换出)

while(true) {

// 实际应用中应有退出逻辑

sleep(1);

}

// 程序退出时自动解锁

munlock(lockedMem, memSize);

munmap(lockedMem);

return 0;

}

实时线程优先级决定了线程在系统中的执行顺序,确保高优先级的线程在就绪时能够立即抢占低优先级线程的执行,从而保证关键路径的确定性延迟。

Linux内核的三种调度策略:

#include <sched.h>

#include <stdio.h>

#include <stdlib.h>

#include <pthread.h>

void* thread_function(void* arg) {

// 线程执行的代码

return NULL;

}

int main() {

pthread_t thread;

struct sched_param param;

int policy;

// 创建线程

if (pthread_create(&thread, NULL, thread_function, NULL) != 0) {

perror("pthread_create");

return EXIT_FAILURE;

}

// 获取当前线程的调度策略和参数

if (pthread_getschedparam(pthread_self(), &policy, ¶m) != 0) {

perror("pthread_getschedparam");

return EXIT_FAILURE;

}

// 设置调度策略为SCHED_FIFO

policy = SCHED_FIFO;

// 设置线程优先级,取值范围为0到sched_get_priority_max(policy)

param.sched_priority = sched_get_priority_max(policy);

// 设置线程的调度策略和优先级

if (pthread_setschedparam(thread, policy, ¶m) != 0) {

perror("pthread_setschedparam");

return EXIT_FAILURE;

}

// 等待线程结束

if (pthread_join(thread, NULL) != 0) {

perror("pthread_join");

return EXIT_FAILURE;

}

return EXIT_SUCCESS;

}

// sched_setscheduler(pid_t pid, int policy, const struct sched_param *param)

// 这是对应调整进程优先级的函数

优先级反转及解决办法

在实时系统中,当高优先级线程因等待低优先级线程持有的资源(如互斥锁)而阻塞时,若中优先级线程抢占CPU,会导致:

L(持锁)→ H(等待锁)→ M(抢占L)→ H持续阻塞优先级继承(PTHREAD_PRIO_INHERIT)

2.优先级天花板(PTHREAD_PRIO_PROTECT)

锁创建时预设天花板优先级,适用于已知资源依赖场景

命令: 使用 chrt (change real-time attributes) 命令,只针对进程调整优先级

# 将PID为 <pid> 的进程设置为 SCHED_FIFO 实时调度策略,优先级为最高的99

sudo chrt -f -p 99 <pid>

chrt 命令的基本语法是:

chrt [选项] <优先级> <命令> [命令参数...]

chrt [选项] -p <优先级> <PID>

<优先级>: 这是一个整数,表示调度优先级。其范围和含义取决于使用的调度策略。

<命令>: 你想要运行并设置其调度策略的命令及其参数。

<PID>: 你想要修改调度策略的现有进程的进程 ID。

chrt 支持多种实时调度策略,其中最常用的是:

--fifo (SCHED_FIFO):先到先服务 (First-In, First-Out)。具有相同优先级的进程会按照它们就绪的顺序执行。一旦一个 FIFO 进程开始运行,它会一直运行,直到它自己主动放弃 CPU、被阻塞(例如等待 I/O),或者被一个具有更高优先级的进程抢占。

--rr (SCHED_RR):轮转 (Round-Robin)。与 SCHED_FIFO 类似,但有一个时间片。当一个 RR 进程的时间片用完时,它会被移到就绪队列的末尾,让同等优先级的其他进程有机会运行。

--other (SCHED_OTHER):普通调度策略。这是系统的默认调度策略,使用 CFS (Completely Fair Scheduler)。

--batch (SCHED_BATCH):批处理调度策略。适用于不需要交互的批处理任务。

--idle (SCHED_IDLE):空闲调度策略。只在系统空闲时运行,优先级最低。

常用选项:

-p: 操作指定的 PID(进程 ID),而不是启动新命令。

-o: 设置 OTHER 调度策略(SCHED_OTHER)。

-f: 设置 FIFO 调度策略(SCHED_FIFO)。

-r: 设置 RR 调度策略(SCHED_RR)。

-b: 设置 BATCH 调度策略(SCHED_BATCH)。

-i: 设置 IDLE 调度策略(SCHED_IDLE)。

-g: 设置 GROUP 调度策略(SCHED_GROUP,不常用)。

-h: 设置 HIGH 调度策略(SCHED_HIGH,不常用)。

-a: 设置 AFR 调度策略(SCHED_AFR,不常用)。

-e: 设置 EDF 调度策略(SCHED_EDF,不常用)。

-d: 设置 DEADLINE 调度策略(SCHED_DEADLINE,不常用)。

-v: 显示 当前进程(或指定 PID)的调度策略和优先级。

--help: 显示帮助信息。

--version: 显示版本信息。

中断绑定是指将中断请求(IRQ)分配到特定的CPU核心上处理,避免中断处理对关键路径的干扰。通过合理地绑定中断,可以减少关键路径上的CPU负载,确保确定性延迟。

识别瓶颈: 在调优前,先使用 top, htop, mpstat -P ALL 1 等工具,观察 si (softirq) 或 %irq 是否在某个CPU核心上过高,确认中断处理是瓶颈。

cat /proc/interruptseth0-rx-0) 找到对应的IRQ号。/proc/irq/<IRQ号>/smp_affinity_list (推荐) 或 smp_affinity (位掩码)。**smp_affinity_list**** (CPU列表)**: 直接写入CPU核心编号。# 示例:将IRQ 128绑定到CPU核心2

sudo sh -c 'echo 2 > /proc/irq/128/smp_affinity_list'

验证效果

cat /proc/interrupts,观察中断计数是否只在绑定的CPU上增长。mpstat -P ALL 1 观察各CPU的 %irq 使用率。遵循NUMA原则: 始终将设备中断绑定到与设备物理位置(PCIe插槽)在同一个NUMA节点的CPU上。

分发负载: 对于多队列设备(如网卡),将每个队列的IRQ均匀地分发到不同的CPU核心上。

irqbalance:自动管理中断的负载均衡,通过配置文件/etc/irqbalance.conf来调整其行为,这个会覆盖上面的精细手动控制的行为。

使用场景:对于关键路径所在的CPU核心,将无关的中断请求绑定到其他核心上,减少该核心的中断处理负担。

在CPU 绑定后,内核线程(如 ksoftirqd、kworker)仍可能抢占绑定核心的用户态线程,时钟中断、RCU 回调也会产生开销;而<font style="color:rgba(0, 0, 0, 0.85) !important;">isolcpus</font>、<font style="color:rgba(0, 0, 0, 0.85) !important;">nohz_full</font>、<font style="color:rgba(0, 0, 0, 0.85) !important;">rcu_nocbs</font>三参数结合可解决此问题:

<font style="color:rgb(0, 0, 0);">isolcpus</font>:将指定 CPU 从内核通用调度器隔离,阻止多数内核线程和普通进程运行;<font style="color:rgb(0, 0, 0);">nohz_full</font>:在隔离核心启用自适应无时钟模式,减少 / 消除时钟中断;<font style="color:rgb(0, 0, 0);">rcu_nocbs</font>:将 RCU 回调卸载到非隔离核心。# 修改GRUB配置

grub_cmdline="isolcpus=8-15 nohz_full=8-15 rcu_nocbs=8-15"

# 生效配置

grub2-mkconfig -o /boot/grub2/grub.cfg

| 配置阶段 | 具体操作 | 目的 | 注意事项 |

|---|---|---|---|

| 一、启动参数配置 | 1. 在引导项中添加 isolcpus=managed_irq,7 2. 添加 nohz_full=7 3. 添加 rcu_nocbs=7 4. 添加 nowatchdog nmi_watchdog=0 5. 添加 hpet=disable 6. 添加 tsc=reliable 7. 添加 mce=off 8. 添加 ipv6.disable=1 9. 添加 audit=0 10. 添加 printk.devkmsg=off quiet loglevel=1 11. 添加selinux=0 |

1. 将核心7从通用调度器隔离,managed_irq 模式允许中断在该CPU上运行但阻止用户/内核线程抢占 2. 启用自适应无滴答模式,在idle时停止周期性时钟中断,显著降低抖动 3. 将RCU回调卸载到非隔离CPU,避免RCU softirq干扰关键线程 4. 禁用NMI watchdog,防止其产生不必要的定时器中断 5. 禁用HPET多播中断源,减少全局中断负载 6. 声明TSC为可靠时间源,避免内核频繁校准带来抖动 7. 关闭机器检查异常(MCE),避免不可屏蔽中断(NMI)打断执行 8. 减少IPv6协议栈相关的后台任务和中断处理 9. 禁用审计子系统,消除 auditd 和 audit backlog 处理带来的不确定性开销 10. 抑制内核日志输出,降低console和syslog写入引起的中断与竞争 11. 禁用 SE Linux 扩展 |

1. isolcpus 必须配合 nohz_full 才能实现真正的“静默”效果;建议使用 isolcpus=managed_irq,<cpu_list>而非旧格式 2. nohz_full 要求目标CPU不运行任何除0号进程外的任务,否则会退化回有滴答模式,确保内核中配置了CONFIG_NO_HZ_FULL=y,可以通过 `cat /boot/config-* |

| 二、中断与任务隔离 | 1. 执行命令:systemctl stop irqbalance && systemctl disable irqbalance 2. 手动绑定所有非关键设备中断(如网卡、磁盘)至非目标CPU(如CPU 0-6): echo <cpu_id> > /proc/irq/<irq_num>/smp_affinity_list 3. 编辑 /sys/devices/virtual/workqueue/cpumask,设置为 0x7F(即 CPU 0-6) 4. (可选)将 ksoftirqd/7 进程手动迁移: taskset -pc 0 $(pgrep ksoftirqd/7) |

1. 防止 irqbalance自动将中断迁移到隔离核心 2. 主动控制IRQ亲和性,确保硬件中断不会落入核心7 3. 限制所有通用工作队列(workqueue)仅在非隔离CPU上运行,防止内核worker抢占 4. 强制将软中断守护进程移出核心7,进一步降低潜在干扰风险 |

1. 禁用 irqbalance 后必须定期检查 /proc/interrupts,防止新设备中断误绑 2. 使用 smp_affinity_list接口比位掩码更直观且不易出错 3. 修改 workqueue/cpumask 需 root 权限,并注意系统更新后可能重置 4. ksoftirqd迁移是临时手段,若未结合 nohz_full效果有限 |

| 三、电源管理优化 | 1. BIOS 中禁用: - Turbo Boost - C-States (C1E, C-State Control) - P-States / SpeedStep - SMT/Hyper-Threading(可选) 2. 内核启动参数添加: intel_pstate=disable processor.max_cstate=1 intel_idle.max_cstate=1 idle=poll 3. 运行时设置频率策略: sudo cpupower frequency-set -g performance 4. 锁定频率(可选): sudo cpupower frequency-set -f <target_freq>MHz 5. 加载 msr 模块并使用 WRMSR 工具固定 UNCORE 频率: modprobe msr wrmsr -p7 0x620 <min_max_ratio> |

1. 消除动态调频(P-State)、自动超频(Turbo)和深度睡眠(C-State)导致的频率波动与唤醒延迟 2. 将CPU保持在浅层C1状态或强制轮询(idle=poll),实现最低延迟响应 3. 确保CPU始终运行于最高稳定频率,避免performance governor切换延迟 4. 固定频率避免dvfs过渡态引入抖动 5. 控制Uncore(LLC、内存控制器)频率一致性,避免跨NUMA带宽波动 | 1. BIOS设置需物理访问服务器或远程KVM操作 2. idle=poll极大增加功耗,仅适用于短期压测或低延迟场景 3. cpupower工具链需提前安装(如 linux-tools-common) 4. MSR操作需谨慎,错误值可能导致系统不稳定或降频 |

| 四、其他关键优化 | 1. 禁用VT-x虚拟化支持(BIOS);避免跨核读写MSR寄存器;降低RDTSC采样频率 2. 使用 chrt 设置实时优先级: chrt -f 99 ./realtime_app 3.echo -1 > /proc/sys/kernel/sched_rt_runtime_us将实时任务的CPU使用时间限制设为无限制 4. NUMA绑定:使用 numactl将进程、内存、I/O设备绑定到同一节点: numactl --cpunodebind=0 --membind=0 --physcpubind=7 ./app 同时将I/O中断亲和性设为另一NUMA节点CPU 5. 检测SMI(System Management Interrupt)开销: Intel: perf stat --smi-cost sleep 10 AMD: perf stat -e ls_smi_rx -I 10000 sleep 1 存在高频SMI时调整BIOS中SMM相关选项 6. 禁用透明大页THP: 方式一:transparent_hugepage=never(boot参数) 方式二:echo never > /sys/kernel/mm/transparent_hugepage/enabled 7. 在计时代码前后插入串行化指令: asm volatile("cpuid" ::: "eax", "ebx", "ecx", "edx"); 再执行 rdtsc 或 使用rdtscp |

1. 减少IPI、VMX相关陷阱及MSR访问引发的微小延迟抖动 2. 提升进程调度优先级,使其能立即抢占普通任务 3. 允许实时任务(RT任务)不受限制使用CPU资源 4. 实现计算、内存、I/O局部性,避免跨NUMA延迟与带宽瓶颈 5. SMI为最高优先级中断,无法被屏蔽,必须通过BIOS调优规避 6. THP后台合并线程(khugepaged)会产生不可预测的延迟尖峰 7. CPUID作为内存屏障,防止RDTSC乱序执行,保证时间戳准确性,RDTSCP会保证前面的指令不会乱序执行到RDTSCP后方 | 1. 禁用VT-x会影响容器、KVM等虚拟化功能 2. chrt -f 99若滥用会导致系统无响应,应仅用于单个关键进程 3. 若RT任务出现死循环,可能导致系统完全无响应 4. NUMA绑定需结合 numactl --show验证实际绑定结果 5. SMI调优依赖具体主板/BMC固件,常见选项包括:USB SMI、Legacy USB Support、PCI Lock等 6. THP禁用后可能影响数据库类应用性能,需权衡场景 7. CPUID带来约50~100 cycle开销,适合高精度测量而非高频采样 |

Linux平台静默工具类

#pragma once

#include <sys/types.h>

#include <unistd.h>

#include <pthread.h>

#include <sched.h>

#include <thread>

#include <fstream>

#include <sstream>

#include <string>

#include <string_view>

#include <vector>

#include <cstdint>

#include <cerrno>

#include <cctype>

#include <algorithm>

#include <climits>

/// 进程优先级等级

enum class PriorityLevel {

LowPriority = -1, ///< 低优先级

NormalPriority = 0, ///< 普通优先级

HighPriority, ///< 高优先级

RealtimePriority ///< 实时优先级

};

/**

* @brief Linux平台进程和线程辅助类

*/

class process_helper {

public:

static inline uint32_t get_pid() noexcept {

return static_cast<uint32_t>(::getpid());

}

static inline bool set_priority(PriorityLevel prio) noexcept {

const int max_prio = ::sched_get_priority_max(SCHED_FIFO);

if (max_prio == -1) return false;

int value;

switch (prio) {

case PriorityLevel::RealtimePriority: value = max_prio; break;

case PriorityLevel::HighPriority: value = max_prio / 2; break;

case PriorityLevel::NormalPriority: value = std::max(1, max_prio / 3); break;

case PriorityLevel::LowPriority: value = 1; break;

default: return false;

}

::sched_param param{value};

return ::sched_setscheduler(0, SCHED_FIFO, ¶m) == 0;

}

static inline bool thread_bind_core(uint32_t cpu) noexcept {

const auto hw_concur = std::thread::hardware_concurrency();

const uint32_t ncpus = hw_concur == 0 ? 1 : static_cast<uint32_t>(hw_concur);

if (cpu >= ncpus) return false;

cpu_set_t mask;

CPU_ZERO(&mask);

CPU_SET(cpu, &mask);

return ::pthread_setaffinity_np(::pthread_self(), sizeof(mask), &mask) == 0;

}

static inline bool set_thread_priority(PriorityLevel prio) noexcept {

const int max_prio = ::sched_get_priority_max(SCHED_FIFO);

if (max_prio == -1) return false;

int value;

switch (prio) {

case PriorityLevel::RealtimePriority: value = max_prio; break;

case PriorityLevel::HighPriority: value = max_prio / 2; break;

case PriorityLevel::NormalPriority: value = std::max(1, max_prio / 3); break;

case PriorityLevel::LowPriority: value = 1; break;

default: return false;

}

::sched_param param{value};

return ::pthread_setschedparam(::pthread_self(), SCHED_FIFO, ¶m) == 0;

}

/**

* @brief 获取设备对应的所有 IRQ 号(支持多队列网卡)

* @return vector<int>,可能为空

*/

static std::vector<int> get_irqs_by_device(std::string_view device) {

std::vector<int> irqs;

std::ifstream file("/proc/interrupts");

if (!file) return irqs;

std::string line;

while (std::getline(file, line)) {

if (line.empty() || line[0] == ' ') continue; // 跳过表头或无效行

// 查找第一个冒号前的 IRQ 号

size_t colon = line.find(':');

if (colon == std::string::npos) continue;

std::string_view irq_part(line.data(), colon);

// 跳过前导空格

size_t start = 0;

while (start < irq_part.size() && std::isspace(irq_part[start])) ++start;

if (start >= irq_part.size()) continue;

char* end_ptr = nullptr;

errno = 0;

long irq = std::strtol(std::string(irq_part.substr(start)).c_str(), &end_ptr, 10);

if (errno != 0 || end_ptr == std::string(irq_part.substr(start)).c_str() || irq < INT_MIN || irq > INT_MAX) {

continue;

}

// 检查行尾是否包含设备名(精确匹配或 [device] 形式)

std::string_view tail(line.data() + colon + 1, line.size() - colon - 1);

if (contains_device(tail, device)) {

irqs.push_back(static_cast<int>(irq));

}

}

return irqs;

}

/**

* @brief 绑定设备的所有 IRQ 到指定 CPU(适用于多队列设备)

*/

static bool bind_device_irqs_to_cpu(std::string_view device, uint32_t cpu) {

auto irqs = get_irqs_by_device(device);

if (irqs.empty()) return false;

bool success = true;

for (int irq : irqs) {

if (!bind_irq_to_cpu(irq, cpu)) success = false;

}

return success;

}

private:

static bool contains_device(std::string_view line, std::string_view target) {

// 去除前导空格

size_t pos = 0;

while (pos < line.size() && std::isspace(line[pos])) ++pos;

if (pos >= line.size()) return false;

std::string_view tokens = line.substr(pos);

// 按空格分割(简单状态机,避免构造 vector<string>)

size_t start = 0;

while (start < tokens.size()) {

// 跳过空格

while (start < tokens.size() && std::isspace(tokens[start])) ++start;

if (start >= tokens.size()) break;

size_t end = start;

while (end < tokens.size() && !std::isspace(tokens[end])) ++end;

std::string_view token = tokens.substr(start, end - start);

// 移除尾部 '+'(如 eth0+)

if (!token.empty() && token.back() == '+') {

token = token.substr(0, token.size() - 1);

}

// 检查 [target] 形式

if (token.size() >= target.size() + 2 &&

token[0] == '[' && token[token.size()-1] == ']') {

std::string_view inner = token.substr(1, token.size() - 2);

if (inner == target) return true;

} else if (token == target) {

return true;

}

start = end;

}

return false;

}

static bool bind_irq_to_cpu(int irq, uint32_t cpu) {

const auto hw_concur = std::thread::hardware_concurrency();

const uint32_t ncpus = hw_concur == 0 ? 1 : static_cast<uint32_t>(hw_concur);

if (cpu >= ncpus) return false;

// 构造十六进制掩码(无前缀,小写)

char mask_str[18]; // 64位最大16字符 + '\0'

int len = snprintf(mask_str, sizeof(mask_str), "%llx", 1ULL << cpu);

if (len <= 0 || static_cast<size_t>(len) >= sizeof(mask_str)) return false;

std::string path = "/proc/irq/" + std::to_string(irq) + "/smp_affinity";

std::ofstream file(path, std::ios::out | std::ios::trunc);

if (!file) return false;

file.write(mask_str, len);

file.put('\n');

return file.good();

}

};

内存模型参考:

https://research.swtch.com/hwmm

https://research.swtch.com/plmm

高级并行编程参考:

https://mirrors.edge.kernel.org/pub/linux/kernel/people/paulmck/perfbook/perfbook.html

内存乱序及内存模型的解决

内存乱序的根源

1. 存储缓冲区(Store Buffer):隐藏写延迟

原理:CPU执行store指令时,若目标缓存行不在本地缓存,需等待内存加载;为避免CPU stall,CPU将store数据先存入“store buffer”,后续再异步写入缓存/内存——store指令可快速完成,但“数据写入内存的顺序”可能晚于“代码中store的顺序”。

// 线程A // 线程B

a = 1; while (b == 0);

b = 1; assert(a == 1); // 可能失败?

结论:store buffer导致“写操作的提交顺序≠代码顺序”,即“写乱序(Store Reordering)”。

2. 无效队列(Invalidate Queue):隐藏缓存一致性延迟

原理:CPU修改共享变量时,需先通过“缓存一致性协议(如MESI)”向其他CPU发送“缓存行无效(Invalidate)”请求;为避免等待所有CPU确认无效,CPU将“无效请求”存入“无效队列”并异步处理——其他CPU可能延迟收到无效请求,导致“读操作看到过时数据”。

// 线程A(CPU 0) // 线程B(CPU 1)

a = 1; while (a == 0);

b = 1;

// 线程C(CPU 0)

while (b == 0);

assert(a == 1); // 可能失败?

结论:无效队列导致“读操作看到的无效通知顺序≠请求发送顺序”,即“读乱序(Load Reordering)”。

3. 乱序执行(Out-of-Order Execution):最大化CPU资源利用率

原理:现代CPU为充分利用流水线与功能单元(如ALU、FPU),会打乱指令执行顺序——只要“逻辑依赖满足”(如c = a + b需等a和b计算完成),无关指令可乱序执行。

对内存访问的影响:内存访问指令(load/store)与计算指令无依赖时,可能被乱序执行——例如a = 1; b = c + d;中,b = c + d可能先执行(若c和d已在寄存器中),但a=1的store仍在store buffer中,导致其他线程先看到b的新值,后看到a的新值。

4. 推测执行(Speculative Execution):提前执行不确定分支

原理:CPU遇到分支(如if (x > 0))时,会推测分支方向并提前执行后续指令;若推测错误,丢弃推测执行的结果(包括内存访问)。

对内存排序的隐性影响:推测执行的内存访问可能“临时修改缓存状态”,虽最终会回滚,但可能被其他CPU通过“侧信道”感知(如Spectre漏洞利用此特性);通过“内存序约束”确保“推测执行的内存访问不影响程序正确性”。

内存模型

定义内存模型,明确“哪些内存访问顺序是硬件必须保证的,哪些是软件可依赖的”,解决“硬件乱序导致软件正确性问题”。

“硬件内存模型”与“语言内存模型”共同构成并行程序的内存访问规则基础。

1. 硬件内存模型

(1)x86/x86-64:强内存模型(Total Store Order, TSO)

规则:

a=1; b=load(c);中,b=load(c)不会先于a=1的store提交到内存;a=1; b=1;中,其他线程不会先看到b=1再看到a=1;a=load(c); b=1;中,b=1不会先于a=load(c)提交;a=load(c); b=load(d);中,若c的缓存行未命中而d的缓存行命中,b可能先获取值,a后获取值。例外:x86的non-temporal store(如_mm_stream_store_si128)与“未对齐内存访问”可能打破TSO规则,需额外加内存屏障。

意义:x86的强内存模型降低了软件复杂度,多数情况下无需手动处理“写→读/写→写/读→写”乱序,但需注意“读→读”乱序与特殊指令的例外。

(2)ARM/PowerPC:弱内存模型(Partial Store Order, PSO / Weak Order)

规则: 允许“写→读”“写→写”“读→写”“读→读”四类乱序(仅禁止“同一地址的访问乱序”);

意义:弱内存模型的硬件性能更高(可更自由地优化内存访问),但软件需通过“显式内存屏障”或“带内存序的原子操作”约束乱序,否则极易出现正确性问题。

2. 语言内存模型:C11/C++11的统一抽象

不同硬件内存模型差异大,C11/C++11通过“语言内存模型”提供统一抽象,屏蔽硬件细节,允许软件按需选择“内存序强度”。

| 内存序枚举 | 核心约束 | 适用场景 |

|---|---|---|

memory_order_relaxed |

仅保证“同一原子变量的访问原子性”,不约束任何乱序(允许所有四类乱序) | 无依赖的统计计数(如网络包计数),仅需原子性,无需顺序保证 |

memory_order_consume |

仅约束“当前load操作与后续依赖于该load结果的操作”的顺序(数据依赖) | 指针加载(如p = atomic_load(&ptr, consume); *p = 1;),仅需保证指针解引用在加载后 |

memory_order_acquire |

约束“当前load操作之后的所有内存访问”不被重排到load之前(读屏障语义) | 锁获取(如pthread_mutex_lock),保证临界区代码看到load之前的所有写操作 |

memory_order_release |

约束“当前store操作之前的所有内存访问”不被重排到store之后(写屏障语义) | 锁释放(如pthread_mutex_unlock),保证store之前的所有写操作被其他线程看到 |

memory_order_acq_rel |

同时具备acquire(读屏障)与release(写屏障)语义,适用于RMW操作 |

原子读写修改(如atomic_fetch_add),需同时保证读和写的顺序约束 |

memory_order_seq_cst |

最强约束:所有线程看到的内存访问顺序一致(全局总序),默认内存序 | 需全局一致性的场景(如分布式锁的状态同步),性能最低但正确性最易保证 |

3. 内存序与硬件屏障的映射关系

软件指定的“内存序”需通过“硬件内存屏障”实现,软件内存序在不同硬件上的“屏障映射”,是“内存序的底层代价”:

| 内存序 | x86/x86-64(TSO) | ARM(弱内存模型) | 核心说明 |

|---|---|---|---|

relaxed |

无屏障 | 无屏障 | 仅依赖硬件原子性,无额外开销 |

consume |

无屏障(TSO禁止关键乱序) | dmb ishld(数据依赖屏障) |

仅约束数据依赖,开销低于acquire |

acquire |

无屏障(TSO禁止读→后续访问乱序) | dmb ish(读屏障) |

约束读操作后的所有访问,开销中等 |

release |

无屏障(TSO禁止写→前序访问乱序) | dmb ish(写屏障) |

约束写操作前的所有访问,开销中等 |

acq_rel |

mfence(全屏障) |

dmb ish(全屏障) |

同时约束读和写,开销较高 |

seq_cst |

mfence + 原子操作带lock前缀 |

dmb sy(系统级全屏障) |

最强约束,开销最高,确保全局总序 |

4.内存屏障与编译器屏障

(1)内存屏障

MFENCE

串行化所有内存操作(读和写)

确保MFENCE之前的所有内存操作(load和store)在MFENCE之后的所有内存操作之前完成

mov [data], eax ; 写操作

mfence ; 内存屏障

mov ebx, [flag] ; 读操作,确保在data写入完成后执行

SFENCE

仅串行化写操作(store)

确保SFENCE之前的写操作在SFENCE之后的写操作之前完成

处理弱排序内存类型(如WC内存)、非临时存储指令(MOVNT)、写组合缓冲区等

movntps [buffer], xmm0 ; 非临时存储

sfence ; 确保写入完成

mov [flag], 1 ; 设置标志

LFENCE

仅串行化读操作(load)

确保LFENCE之前的读操作在LFENCE之后的读操作之前完成

控制依赖于读操作结果的执行顺序,防止推测执行导致的信息泄露(如Spectre漏洞缓解)

mov eax, [secret_data] ; 读取敏感数据

lfence ; 阻止后续指令基于错误预测执行

mov [result], eax ; 使用读取的结果

(2)编译器屏障

C11/C++11标准

#include <stdatomic.h>

atomic_signal_fence(memory_order_seq_cst); // 编译器屏障

GCC/Clang

__asm__ __volatile__("" ::: "memory"); // 告诉编译器内存被修改,防止重排序

MSVC

_ReadWriteBarrier(); // 编译器屏障

(3)区别

编译器屏障:编译器屏障不能强制 CPU 层面执行同步操作,仅仅是防止编译器重排代码。

内存屏障:内存屏障同时防止了编译器重排

4. 选择“最弱够用”的内存序

relaxed;acquire/release;seq_cst,且需评估性能代价;seq_cst,但90%的场景无需此强约束,手动指定弱内存序可大幅提升性能。缓存一致性协议讲解参考:

https://www.scss.tcd.ie/Jeremy.Jones/VivioJS/caches/MESIHelp.htm

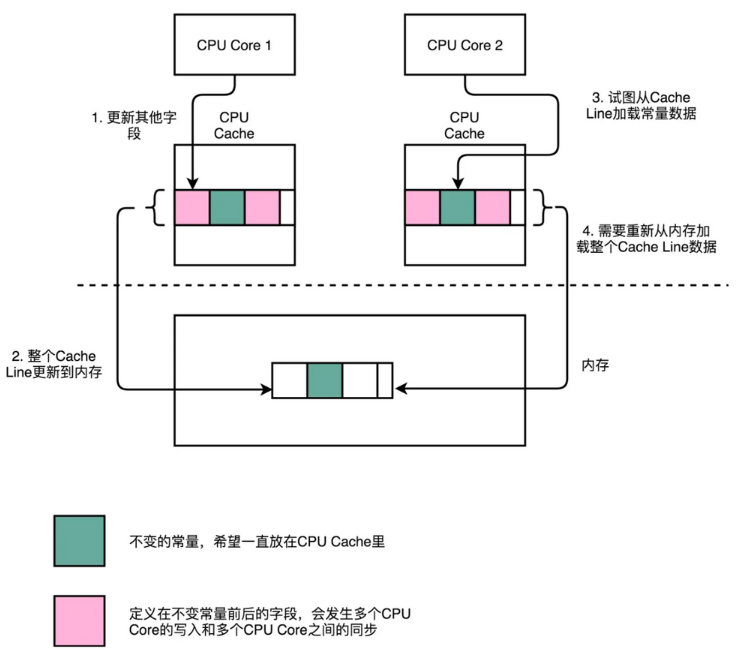

缓存一致性协议带来的问题及解决:伪共享、真共享

在多线程编程中,伪共享(False Sharing)是指多个线程同时访问位于同一个缓存行(Cache Line)但实际上没有数据依赖关系的不同变量,导致缓存行频繁失效和不必要的内存同步开销。通过CPU缓存行对齐(Cache Line Alignment)可以有效地减少伪共享问题,以下是具体的方法:

#include <iostream>

#include <thread>

#include <atomic>

#include <array>

// 定义缓存行大小

constexpr size_t CACHE_LINE_SIZE = 64;

// 使用结构体填充实现缓存行对齐

struct AlignedData {

std::atomic<long long> value;

char padding[CACHE_LINE_SIZE - sizeof(std::atomic<long long>)];

};

// 共享数据结构,每个元素都是一个对齐后的结构体

std::array<AlignedData, 2> shared_data;

// 线程函数,每个线程修改自己的数据

void thread_function(int index) {

for (int i = 0; i < 10000000; ++i) {

shared_data[index].value++;

}

}

int main() {

// 创建两个线程

std::thread thread1(thread_function, 0);

std::thread thread2(thread_function, 1);

// 等待线程结束

thread1.join();

thread2.join();

// 输出结果

std::cout << "Thread 0 value: " << shared_data[0].value << std::endl;

std::cout << "Thread 1 value: " << shared_data[1].value << std::endl;

return 0;

}

__attribute__((aligned(CACHE_LINE_SIZE)))来指定结构体的对齐方式:struct __attribute__((aligned(CACHE_LINE_SIZE))) AlignedData {

std::atomic<long long> value;

};

//C++自己的方式

template <typename T>

struct alignas(CACHE_LINE_SIZE) CacheLineAligned : public T {

using T::T;

};

// 这种方式更加简洁,并且可以确保结构体在内存中的对齐符合缓存行的大小要求。

真共享问题可以通过 std::atomic(性能不敏感)和 thread_local 解决问题。

缓存隔离

Intel 缓存分配技术(CAT)可将 L3 缓存划分为容量可配置的 COS 区域,能将关键低延迟交易线程绑定到专属 COS 区域,避免其缓存行被后台任务或其他核心污染,从而减少缓存争用导致的延迟抖动。

sudo apt update

sudo apt install -y intel-cmt-cat

# 检查CPU是否支持CAT和MBA

cat /proc/cpuinfo | grep -E 'cat_l3|mba'

# 使用pqos工具全面检测系统RDT功能

pqos -d

# 查看当前系统默认配置

pqos -s

# 创建COS定义

# -e 'llc:COS_ID=BITMASK' (L3 Cache Allocation)

# -e 'mba:COS_ID=BANDWIDTH' (Memory Bandwidth Allocation)

# COS1: 分配L3缓存的高8位 (例如总共12位掩码时,0xff0代表大部分缓存)

# 同时分配80%的内存带宽

sudo pqos -e 'llc:1=0xff0;mba:1=80'

# COS2: 分配L3缓存的低4位 (0x00f)

# 同时分配50%的内存带宽 (如果带宽不足,会受到限制)

sudo pqos -e 'llc:2=0x0f;mba:2=50'

# 验证配置是否生效

pqos -s

# 将核心 2 和 3 绑定到 COS1

# 格式: pqos -a 'llc:COS_ID=core_list;mba:COS_ID=core_list'

sudo pqos -a 'llc:1=2,3;mba:1=2,3'

# (可选)可以将其他核心绑定到普通任务COS2

# sudo pqos -a 'llc:2=4-7;mba:2=4-7'

sudo apt install -y stress

# -c 1: 产生1个占用CPU的进程

# -m 1: 产生1个占用内存的进程

# --vm-bytes 512M: 分配512MB内存

# taskset -c 2: 将进程绑定到核心2

taskset -c 2 stress -c 1 -m 1 --vm-bytes 512M &

STRESS_PID=$! # 获取后台进程的PID,方便后续停止

echo "Stress test started with PID: $STRESS_PID"

# 监控与COS1关联的核心2和3

# -i 1: 每1秒刷新一次

# -m llc,mbl,mbr: 监控指标包括LLC(缓存占用), MBL(本地内存带宽), MBR(远程内存带宽)

sudo pqos -i 1 -m 'llc,mbl,mbr:2,3'

# 停止压力测试进程

kill $STRESS_PID

# 重置所有RDT配置到系统默认状态

sudo pqos -R

cpu pipeline参考:

https://weedge.github.io/perf-book-cn/zh/chapters/3-CPU-Microarchitecture/3-2_Pipelining_cn.html

流水线停顿规避与ILP利用

现代CPU通过流水线将指令执行拆分为“取指(IF)、译码(ID)、执行(EX)、访存(MEM)、写回(WB)”等阶段,理想情况下每时钟周期可完成一条指令。实际指令间依赖导致流水线停顿(Stall),等待前一阶段结果,CPU周期浪费。

流水线停顿的两类指令间依赖:

a = b + c; d = a + e中,d依赖a的结果),导致d的“执行阶段”需等待a的“写回阶段”。if-else)的目标地址需等待执行阶段确定,导致后续指令无法提前取指,产生停顿,分支预测错误时停顿更久。CPU pipeline适配的“三优先”原则,确保流水线无停顿、ILP最大化:

复杂结构、系统全局的依赖链优化拆分使用拓扑排序等算法解决依赖。

1. 非线程安全内存池(对象池),实际场景也是线程私有的

#pragma once

#include <cstdint>

#include <vector>

#include <string>

#include "macros.h"

namespace Common {

template<typename T>

class MemPool final {

public:

explicit MemPool(std::size_t num_elems) :

store_(num_elems, {T(), true}) /* pre-allocation of vector storage. */ {

ASSERT(reinterpret_cast<const ObjectBlock *>(&(store_[0].object_)) == &(store_[0]), "T object should be first member of ObjectBlock.");

}

/// Allocate a new object of type T, use placement new to initialize the object, mark the block as in-use and return the object.

template<typename... Args>

T *allocate(Args... args) noexcept {

auto obj_block = &(store_[next_free_index_]);

#if !defined(NDEBUG)

ASSERT(obj_block->is_free_, "Expected free ObjectBlock at index:" + std::to_string(next_free_index_));

#endif

T *ret = &(obj_block->object_);

ret = new(ret) T(args...); // placement new.

obj_block->is_free_ = false;

updateNextFreeIndex();

return ret;

}

/// Return the object back to the pool by marking the block as free again.

/// Destructor is not called for the object.

auto deallocate(const T *elem) noexcept {

const auto elem_index = (reinterpret_cast<const ObjectBlock *>(elem) - &store_[0]);

#if !defined(NDEBUG)

ASSERT(elem_index >= 0 && static_cast<size_t>(elem_index) < store_.size(), "Element being deallocated does not belong to this Memory pool.");

ASSERT(!store_[elem_index].is_free_, "Expected in-use ObjectBlock at index:" + std::to_string(elem_index));

#endif

store_[elem_index].is_free_ = true;

}

// Deleted default, copy & move constructors and assignment-operators.

MemPool() = delete;

MemPool(const MemPool &) = delete;

MemPool(const MemPool &&) = delete;

MemPool &operator=(const MemPool &) = delete;

MemPool &operator=(const MemPool &&) = delete;

private:

/// Find the next available free block to be used for the next allocation.

auto updateNextFreeIndex() noexcept {

const auto initial_free_index = next_free_index_;

while (!store_[next_free_index_].is_free_) {

++next_free_index_;

if (UNLIKELY(next_free_index_ == store_.size())) { // hardware branch predictor should almost always predict this to be false any ways.

next_free_index_ = 0;

}

if (UNLIKELY(initial_free_index == next_free_index_)) {

#if !defined(NDEBUG)

ASSERT(initial_free_index != next_free_index_, "Memory Pool out of space.");

#endif

}

}

}

/// It is better to have one vector of structs with two objects than two vectors of one object.

/// Consider how these are accessed and cache performance.

struct ObjectBlock {

T object_;

bool is_free_ = true;

};

/// We could've chosen to use a std::array that would allocate the memory on the stack instead of the heap.

/// We would have to measure to see which one yields better performance.

/// It is good to have objects on the stack but performance starts getting worse as the size of the pool increases.

std::vector<ObjectBlock> store_;

size_t next_free_index_ = 0;

};

}

优化版本如下

#pragma once

#include <cstdint>

#include <vector>

#include <string>

#include "macros.h"

namespace Common {

template<typename T>

class MemPool final {

public:

explicit MemPool(std::size_t num_elems) :

objects_(nullptr),

next_free_index_(0),

capacity_(num_elems) {

// Pre-allocate memory using standard allocation (avoiding new/delete)

objects_ = static_cast<T*>(std::aligned_alloc(alignof(T), sizeof(T) * capacity_));

free_list_ = static_cast<std::size_t*>(std::aligned_alloc(alignof(std::size_t), sizeof(std::size_t) * capacity_));

// Initialize free list - each slot points to the next one

for (std::size_t i = 0; i < capacity_; ++i) {

free_list_[i] = i + 1;

}

free_list_[capacity_ - 1] = kInvalidIndex; // Last element points to invalid

}

~MemPool() {

// Explicitly call destructors for any non-freed objects

for (std::size_t i = 0; i < capacity_; ++i) {

if (free_list_[i] == kInvalidIndex) { // Object is allocated

objects_[i].~T();

}

}

// Free pre-allocated memory

std::free(objects_);

std::free(free_list_);

}

/// Allocate a new object of type T, use placement new to initialize the object, mark the block as in-use and return the object.

template<typename... Args>

T *allocate(Args... args) noexcept {

if (UNLIKELY(next_free_index_ == kInvalidIndex)) {

return nullptr; // Pool exhausted

}

const auto index = next_free_index_;

next_free_index_ = free_list_[index]; // Move to next free slot

T *ret = &(objects_[index]);

new (ret) T(std::forward<Args>(args)...); // placement new

free_list_[index] = kInvalidIndex; // Mark as allocated

return ret;

}

/// Return the object back to the pool by marking the block as free again.

/// Destructor is not called for the object - lazy deallocation for performance.

auto deallocate(const T *elem) noexcept {

const auto elem_index = static_cast<std::size_t>(elem - objects_);

if (LIKELY(elem_index < capacity_)) {

// Instead of calling destructor, just add back to free list

free_list_[elem_index] = next_free_index_;

next_free_index_ = elem_index;

}

}

// Deleted default, copy & move constructors and assignment-operators.

MemPool() = delete;

MemPool(const MemPool &) = delete;

MemPool(const MemPool &&) = delete;

MemPool &operator=(const MemPool &) = delete;

MemPool &operator=(const MemPool &&) = delete;

private:

static constexpr std::size_t kInvalidIndex = static_cast<std::size_t>(-1);

T* objects_; // Pre-allocated array of objects

std::size_t* free_list_; // Free list - each slot points to the next free slot, or kInvalidIndex if allocated

std::size_t next_free_index_; // Head of free list

std::size_t capacity_; // Total capacity of the pool

};

}

2. 内存调优

#include <iostream>

#include <unistd.h>

#include <malloc.h>

#include <sys/mman.h>

void configure_memory_behavior() {

// 禁用大块内存的 mmap 分配:所有 malloc 请求通过堆(sbrk)满足

if (mallopt(M_MMAP_MAX, 0) != 1) {

std::cerr << "Warning: Failed to set M_MMAP_MAX. Error: " << std::strerror(errno) << "\n";

}

// 禁用堆自动修剪:防止 free 后调用 sbrk 归还内存,避免系统调用开销和延迟波动

if (mallopt(M_TRIM_THRESHOLD, -1) != 1) {

std::cerr << "Warning: Failed to set M_TRIM_THRESHOLD. Error: " << std::strerror(errno) << "\n";

}

// 强制单arena:所有线程共享主堆,避免thread arena的mmap扩展和带来的不确定性

if (mallopt(M_ARENA_MAX, 1) != 1) {

std::cerr << "Warning: Failed to set M_ARENA_MAX. Error: " << std::strerror(errno) << "\n";

}

// 固定mmap阈值:确保大小块划分策略稳定(即使已禁用mmap)

if (mallopt(M_MMAP_THRESHOLD, 131072) != 1) {

std::cerr << "Warning: Failed to set M_MMAP_THRESHOLD. Error: " << std::strerror(errno) << "\n";

}

// 锁定当前进程中所有已映射的页面 和 锁定未来所有将要映射的页面

if (mlockall(MCL_CURRENT | MCL_FUTURE) == -1) {

std::cerr << "Warning: mlockall failed. Check permissions (CAP_IPC_LOCK) and ulimit.\n";

}

}

# 临时禁用

sudo swapoff -a

#永久禁用,注释掉所有包含 swap 的行

sudo vim /etc/fstab

# 临时设置

sudo sysctl vm.swappiness=0

# 永久设置

echo "vm.swappiness=0" | sudo tee /etc/sysctl.d/99-disable-swap.conf

sudo sysctl -p

# 程序中使用mlockall()也是强制禁用,是针对整个进程的

# 预防系统的 memlock 限制过低,以下命令检查。

ulimit -l

# 临时提升限制 (例如到1GB)

sudo ulimit -l 1048576

# 注意: sudo提升的ulimit只对该sudo命令内的程序生效,需要以一种能传递给子进程的方式运行

# 更可靠的方式是修改配置文件或以root身份运行

# 永久修改

编辑 /etc/security/limits.conf 文件,为用户添加 memlock 的 unlimited 权限,然后重新登录。

# Allow the 'trader' user to lock an unlimited amount of memory

trader soft memlock unlimited

trader hard memlock unlimited

# 设置 vm.swappiness=0 并由应用调用 mlockall()。

# 临时设置

sudo sysctl vm.swappiness=0

# 永久设置,在 /etc/sysctl.d/ 目录下创建一个新的配置文件。

sudo vim /etc/sysctl.d/custom-latency.conf

添加vm.swappiness=0

sudo sysctl -p

# 通过以上设置可以无需下面获取权限来执行了

# mlock 和 mlockall 调用需要sudo权限

# 仅授予程序锁定内存的权限

sudo setcap cap_ipc_lock=+ep ./arena_test

# 完整权限

sudo ./arena_test

// 调整glibc分配器以锁定内存中的页,并防止将它们释放到操作系统,这些技术中的一些或全部可能已经集成到 jemalloc、tcmalloc 或 mimalloc 等内存分配库中

// 将 M_MMAP_MAX 设置为 0 会禁用底层 mmap 系统调用用于大分配 - 这是必要的,因为当库尝试将 mmap 过的段释放回操作系统时,mlockall 可能会被 munmap 撤销,从而挫败我们的努力。

// 将 M_TRIM_THRESHOLD 设置为 -1 可以防止 glibc 在调用 free 后将内存返回给操作系统。正如之前所说,此选项对 mmap 过的段没有影响。

// 最后,将 M_ARENA_MAX 设置为 1 可以防止 glibc 通过 mmap 分配多个 arena 以容纳多个内核。请记住,后者会妨碍 glibc 分配器多线程可扩展性特性。

// 结合起来,这些设置将 glibc 强制转换为堆分配,直到应用程序结束才会将内存释放回操作系统。该进程生成的任何线程的堆栈也将被预处理并锁定。这种技术的缺点是它减少了系统上其他进程可用的内存量。

#include <malloc.h>

#include <sys/mman.h>

mallopt(M_MMAP_MAX, 0);

mallopt(M_TRIM_THRESHOLD, -1);

mallopt(M_ARENA_MAX, 1);

mlockall(MCL_CURRENT | MCL_FUTURE);

char *mem = malloc(size);

for (int i = 0; i < size; i += sysconf(_SC_PAGESIZE))

mem[i] = 0;

//...

free(mem);

// 如何检测多线程应用程序中的 TLB 驱逐?一种简单的方法是检查 /proc/interrupts 中的 TLB 行。

// 一种检测运行时连续 TLB 中断的有用方法是在查看此文件时使用 watch 命令

// 运行 watch -n5 -d 'grep TLB /proc/interrupts', 其中 -n 5 选项每 5 秒刷新视图,而 -d 则突出显示每次刷新输出之间的差异。

CPU0 CPU1 CPU2 CPU3

...

NMI: 0 0 0 0 Non-maskable interrupts

LOC: 552219 1010298 2272333 3179890 Local timer interrupts

SPU: 0 0 0 0 Spurious interrupts

...

IWI: 0 0 0 0 IRQ work interrupts

RTR: 7 0 0 0 APIC ICR read retries

RES: 18708 9550 771 528 Rescheduling interrupts

CAL: 711 934 1312 1261 Function call interrupts

TLB: 4493 6108 73789 5014 TLB shootdowns

// 注意其他内核数量级上的差异。在这种情况下,这种行为的罪魁祸首是 Linux 内核的一个名为自动 NUMA 平衡的功能,可以通过 sysctl -w numa_balancing=0 轻松禁用。

// 防止 TLB 驱逐需要限制对共享进程地址空间进行的更新次数。

// 在源代码层面,应该避免运行时执行这些系统调用,即 munmap、mprotect 和 madvise。

// 在操作系统层面,禁用内核功能,这些功能会因其功能而导致 TLB 驱逐,例如透明大页和自动 NUMA 平衡。

3. 合理选择数据结构

根据实际需求选择合适的数据结构,避免使用会导致频繁内存分配和释放的数据结构。例如,如果需要频繁插入和删除元素,可以考虑使用std::list而不是std::vector。

**栈分配 **:对于大小固定的、生命周期短暂的数据,直接在栈上创建 std::array。大小必须在编译时确定。

4.pinned_arena+allocator(STL动态内存容器内存分配器)

// pinned_arena.h

#pragma once

#include <cstddef>

#include <cstdint>

#include <memory>

#include <stdexcept>

#include <iostream>

#include <vector>

#include <string>

#include <cstring>

#include <unistd.h>

#include <sys/mman.h>

#include <malloc.h>

// 分支预测和优化宏

#if defined(__GNUC__) || defined(__clang__)

#define LIKELY(x) __builtin_expect(!!(x), 1)

#define UNLIKELY(x) __builtin_expect(!!(x), 0)

#define ALWAYS_INLINE inline __attribute__((always_inline))

#define HOT_PATH [[gnu::hot]]

#define COLD_PATH [[gnu::cold]]

#else

#define LIKELY(x) (x)

#define UNLIKELY(x) (x)

#define ALWAYS_INLINE inline

#define HOT_PATH

#define COLD_PATH

#endif

#define CACHELINE_ALIGN alignas(64)

#define CACHELINE_SIZE 64

namespace Common {

// 编译期内存对齐计算

template<size_t N>

constexpr size_t next_power_of_two() {

static_assert(N > 0, "Size must be positive");

size_t value = 1;

while (value < N) value <<= 1;

return value;

}

// 固定内存竞技场

class PinnedArena {

private:

// 内存块结构

struct CACHELINE_ALIGN MemoryBlock {

size_t used;

size_t capacity;

bool is_active;

uint32_t next_block; // 使用索引而非指针,提高缓存局部性

char padding[40]; // 填充到64字节避免伪共享

ALWAYS_INLINE char* data() {

return reinterpret_cast<char*>(this + 1);

}

ALWAYS_INLINE const char* data() const {

return reinterpret_cast<const char*>(this + 1);

}

static constexpr size_t header_size = sizeof(MemoryBlock);

static constexpr size_t min_capacity = 4096 - header_size;

};

// 预分配的连续内存区域

struct CACHELINE_ALIGN ArenaMemory {

void* raw_memory;

size_t total_size;

size_t block_size;

uint32_t num_blocks;

bool is_locked;

MemoryBlock* blocks; // 连续的内存块数组

char* data_start; // 连续的数据区域

};

ArenaMemory arena_mem_;

uint32_t current_block_idx_;

uint32_t active_blocks_;

const bool allow_fallback_;

const bool use_mlock_;

// 禁止拷贝

PinnedArena(const PinnedArena&) = delete;

PinnedArena& operator=(const PinnedArena&) = delete;

public:

explicit PinnedArena(size_t block_size = 64 * 1024,

bool allow_fallback = false,

bool use_mlock = true,

uint32_t prealloc_blocks = 16) // 预分配块数

: allow_fallback_(allow_fallback)

, use_mlock_(use_mlock)

, current_block_idx_(0)

, active_blocks_(1) {

// 初始化连续内存区域

initialize_arena_memory(block_size, prealloc_blocks);

// 预取第一个内存块到缓存

if (LIKELY(arena_mem_.blocks != nullptr)) {

prefetch_memory(arena_mem_.blocks[0].data(),

std::min(block_size, size_t(4096)));

}

}

~PinnedArena() {

destroy_arena_memory();

}

// 移动语义支持

PinnedArena(PinnedArena&& other) noexcept

: arena_mem_(other.arena_mem_)

, current_block_idx_(other.current_block_idx_)

, active_blocks_(other.active_blocks_)

, allow_fallback_(other.allow_fallback_)

, use_mlock_(other.use_mlock_) {

other.arena_mem_.raw_memory = nullptr;

other.arena_mem_.blocks = nullptr;

other.arena_mem_.data_start = nullptr;

}

PinnedArena& operator=(PinnedArena&& other) noexcept {

if (LIKELY(this != &other)) {

destroy_arena_memory();

arena_mem_ = other.arena_mem_;

current_block_idx_ = other.current_block_idx_;

active_blocks_ = other.active_blocks_;

other.arena_mem_.raw_memory = nullptr;

other.arena_mem_.blocks = nullptr;

other.arena_mem_.data_start = nullptr;

}

return *this;

}

// 核心分配函数 - 热路径优化

HOT_PATH ALWAYS_INLINE

void* allocate(size_t size, size_t alignment = alignof(std::max_align_t)) {

// 快速路径:在当前活跃块分配

MemoryBlock* current_block = &arena_mem_.blocks[current_block_idx_];

if (LIKELY(current_block->is_active && size <= arena_mem_.block_size / 4)) {

char* ptr = current_block->data() + current_block->used;

uintptr_t aligned_ptr = (reinterpret_cast<uintptr_t>(ptr) + alignment - 1) & ~(alignment - 1);

size_t adjustment = aligned_ptr - reinterpret_cast<uintptr_t>(ptr);

size_t total_size = size + adjustment;

if (LIKELY(current_block->used + total_size <= current_block->capacity)) {

current_block->used += total_size;

// 预取即将使用的内存

prefetch_memory(reinterpret_cast<void*>(aligned_ptr), size);

return reinterpret_cast<void*>(aligned_ptr);

}

}

// 慢速路径

return allocate_slow_path(size, alignment);

}

// 批量数组分配 - 缓存友好

template<typename T>

HOT_PATH ALWAYS_INLINE

T* allocate_array(size_t count) {

static_assert(std::is_trivial_v<T>, "Only trivial types supported for array allocation");

constexpr size_t alignment = alignof(T);

const size_t total_size = count * sizeof(T);

MemoryBlock* current_block = &arena_mem_.blocks[current_block_idx_];

if (LIKELY(current_block->is_active)) {

char* ptr = current_block->data() + current_block->used;

uintptr_t aligned_ptr = (reinterpret_cast<uintptr_t>(ptr) + alignment - 1) & ~(alignment - 1);

size_t adjustment = aligned_ptr - reinterpret_cast<uintptr_t>(ptr);

size_t total_needed = total_size + adjustment;

if (LIKELY(current_block->used + total_needed <= current_block->capacity)) {

current_block->used += total_needed;

T* result = reinterpret_cast<T*>(aligned_ptr);

// 多级预取优化

prefetch_array(result, count);

return result;

}

}

return reinterpret_cast<T*>(allocate_slow_path(total_size, alignment));

}

// 重置竞技场

HOT_PATH ALWAYS_INLINE

void reset() noexcept {

// 重置所有活跃块 - 连续内存访问,缓存友好

for (uint32_t i = 0; i < active_blocks_; ++i) {

arena_mem_.blocks[i].used = 0;

// 预取每个块的数据区域

if (LIKELY(arena_mem_.blocks[i].is_active && arena_mem_.blocks[i].capacity > 0)) {

prefetch_memory(arena_mem_.blocks[i].data(),

std::min(arena_mem_.blocks[i].capacity, size_t(4096)));

}

}

current_block_idx_ = 0;

}

// 清空所有内存块

void clear() noexcept {

reset();

// 不清除预分配的内存区域,保持mlock状态

}

// 统计信息

size_t memory_usage() const noexcept {

return arena_mem_.total_size;

}

size_t block_count() const noexcept {

return active_blocks_;

}

private:

// 初始化连续内存区域

void initialize_arena_memory(size_t block_size, uint32_t num_blocks) {

if (UNLIKELY(num_blocks == 0)) {

return;

}

// 计算总内存大小

size_t block_total_size = MemoryBlock::header_size + block_size;

size_t total_memory_size = block_total_size * num_blocks;

// 页对齐

long page_size = sysconf(_SC_PAGESIZE);

if (UNLIKELY(page_size == -1)) {

page_size = 4096;

}

size_t aligned_total_size = ((total_memory_size + page_size - 1) / page_size) * page_size;

// 分配连续内存

void* raw_memory = nullptr;

if (UNLIKELY(posix_memalign(&raw_memory, page_size, aligned_total_size) != 0)) {

return;

}

// 内存锁定

if (LIKELY(use_mlock_)) {

if (UNLIKELY(mlock(raw_memory, aligned_total_size) == -1)) {

// 简化错误处理以减少系统调用

}

}

// Pre-faulting: 触发所有缺页中断

memset(raw_memory, 0, aligned_total_size);

// 设置内存区域信息

arena_mem_.raw_memory = raw_memory;

arena_mem_.total_size = aligned_total_size;

arena_mem_.block_size = block_size;

arena_mem_.num_blocks = num_blocks;

arena_mem_.is_locked = use_mlock_;

// 初始化内存块数组

arena_mem_.blocks = static_cast<MemoryBlock*>(raw_memory);

arena_mem_.data_start = reinterpret_cast<char*>(arena_mem_.blocks) +

(MemoryBlock::header_size * num_blocks);

// 初始化每个内存块

for (uint32_t i = 0; i < num_blocks; ++i) {

MemoryBlock* block = &arena_mem_.blocks[i];

block->used = 0;

block->capacity = block_size;

block->is_active = (i == 0); // 只有第一个块初始激活

block->next_block = (i + 1 < num_blocks) ? (i + 1) : 0;

}

active_blocks_ = 1;

}

// 销毁内存区域

void destroy_arena_memory() noexcept {

if (UNLIKELY(arena_mem_.raw_memory == nullptr)) return;

if (arena_mem_.is_locked) {

munlock(arena_mem_.raw_memory, arena_mem_.total_size);

}

free(arena_mem_.raw_memory);

arena_mem_.raw_memory = nullptr;

arena_mem_.blocks = nullptr;

arena_mem_.data_start = nullptr;

}

// 慢速分配路径

COLD_PATH

void* allocate_slow_path(size_t size, size_t alignment) {

// 尝试在当前块分配(可能由于对齐要求失败)

MemoryBlock* current_block = &arena_mem_.blocks[current_block_idx_];

if (LIKELY(current_block->is_active)) {

char* ptr = current_block->data() + current_block->used;

uintptr_t aligned_ptr = (reinterpret_cast<uintptr_t>(ptr) + alignment - 1) & ~(alignment - 1);

size_t adjustment = aligned_ptr - reinterpret_cast<uintptr_t>(ptr);

size_t total_size = size + adjustment;

if (current_block->used + total_size <= current_block->capacity) {

current_block->used += total_size;

prefetch_memory(reinterpret_cast<void*>(aligned_ptr), size);

return reinterpret_cast<void*>(aligned_ptr);

}

}

// 尝试激活新块

if (LIKELY(size <= arena_mem_.block_size && active_blocks_ < arena_mem_.num_blocks)) {

// 激活下一个块

uint32_t next_idx = current_block_idx_ + 1;

if (LIKELY(next_idx < arena_mem_.num_blocks)) {

MemoryBlock* next_block = &arena_mem_.blocks[next_idx];

next_block->is_active = true;

next_block->used = 0;

current_block_idx_ = next_idx;

active_blocks_++;

char* ptr = next_block->data();

uintptr_t aligned_ptr = (reinterpret_cast<uintptr_t>(ptr) + alignment - 1) & ~(alignment - 1);

size_t adjustment = aligned_ptr - reinterpret_cast<uintptr_t>(ptr);

if (LIKELY(size + adjustment <= next_block->capacity)) {

next_block->used = size + adjustment;

prefetch_memory(reinterpret_cast<void*>(aligned_ptr), size);

return reinterpret_cast<void*>(aligned_ptr);

}

}

}

// 大对象或回退分配

if (UNLIKELY(allow_fallback_)) {

// 使用更轻量级的分配方式

void* ptr = malloc(size);

if (UNLIKELY(ptr == nullptr)) {

return nullptr;

}

prefetch_memory(ptr, size);

return ptr;

}

return nullptr;

}

// 内存预取优化

ALWAYS_INLINE void prefetch_memory(void* addr, size_t size) const {

#if defined(__GNUC__) || defined(__clang__)

char* ptr = static_cast<char*>(addr);

// 预取多个缓存行,限制范围避免过度预取

for (size_t i = 0; i < size && i < 1024; i += CACHELINE_SIZE) {

__builtin_prefetch(ptr + i, 1, 3); // 预写,高局部性

}

#endif

}

// 数组预取优化

template<typename T>

ALWAYS_INLINE void prefetch_array(T* array, size_t count) const {

if (UNLIKELY(count == 0)) return;

#if defined(__GNUC__) || defined(__clang__)

// 预取前几个元素

__builtin_prefetch(array, 1, 3);

// 对于大数组,预取更多元素

if (LIKELY(count > 8)) {

__builtin_prefetch(array + 8, 1, 2);

if (count > 16) {

__builtin_prefetch(array + 16, 1, 1);

}

}

#endif

}

};

// STL兼容的低延迟分配器

template<typename T>

class LowLatencyAllocator {

public:

using value_type = T;

using pointer = T*;

using const_pointer = const T*;

using reference = T&;

using const_reference = const T&;

using size_type = std::size_t;

using difference_type = std::ptrdiff_t;

using propagate_on_container_copy_assignment = std::false_type;

using propagate_on_container_move_assignment = std::true_type;

using propagate_on_container_swap = std::true_type;

using is_always_equal = std::false_type;

template<typename U>

struct rebind {

using other = LowLatencyAllocator<U>;

};

explicit LowLatencyAllocator(PinnedArena& arena) noexcept : arena_(&arena) {}

LowLatencyAllocator(const LowLatencyAllocator& other) noexcept = default;

template<typename U>

LowLatencyAllocator(const LowLatencyAllocator<U>& other) noexcept

: arena_(other.arena_) {}

// 内存分配

HOT_PATH ALWAYS_INLINE

pointer allocate(size_type n) {

// 小数组快速路径

if (LIKELY(n <= 16)) {

return arena_->allocate_array<T>(n);

}

// 大数组路径

void* ptr = arena_->allocate(n * sizeof(T), alignof(T));

return static_cast<pointer>(ptr);

}

// 内存释放 - 无操作(由arena统一管理)

void deallocate(pointer p, size_type n) noexcept {

(void)p;

(void)n;

}

// 构造对象

template<typename U, typename... Args>

void construct(U* p, Args&&... args) {

::new (static_cast<void*>(p)) U(std::forward<Args>(args)...);

}

// 销毁对象

template<typename U>

void destroy(U* p) {

p->~U();

}

PinnedArena* arena() const noexcept { return arena_; }

template<typename U>

bool operator==(const LowLatencyAllocator<U>& other) const noexcept {

return arena_ == other.arena_;

}

template<typename U>

bool operator!=(const LowLatencyAllocator<U>& other) const noexcept {

return arena_ != other.arena_;

}

private:

PinnedArena* arena_;

};

// 便捷容器创建函数

template<typename T, typename... Args>

auto make_pinned_vector(PinnedArena& arena, Args&&... args) {

return std::vector<T, LowLatencyAllocator<T>>(

std::forward<Args>(args)...,

LowLatencyAllocator<T>(arena)

);

}

} // namespace Common

#include "pinned_arena.h"

#include <iostream>

#include <vector>

using namespace Common;

int main()

{

PinnedArena arena(64 * 1024, false, true, 4);

std::vector<int, LowLatencyAllocator<int>> int_vec(LowLatencyAllocator<int>(arena));

for (int i = 0; i < 5; ++i)

{

int_vec.push_back(i * 10); // 0, 10, 20, 30, 40

}

std::cout << "int_vec 内容: ";

for (const auto &val : int_vec)

{

std::cout << val << " ";

}

std::cout << "\nint_vec 内存地址: " << static_cast<void *>(int_vec.data()) << std::endl;

auto str_vec = make_pinned_vector<std::string>(arena);

str_vec.emplace_back("hello");

str_vec.emplace_back("pinned");

str_vec.emplace_back("arena");

std::cout << "str_vec 内容: ";

for (const auto &s : str_vec)

{

std::cout << s << " ";

}

std::cout << "\nstr_vec 内存地址: " << static_cast<void *>(str_vec.data()) << std::endl;

arena.reset();

std::vector<double, LowLatencyAllocator<double>> double_vec(LowLatencyAllocator<double>(arena));

double_vec.push_back(3.14);

double_vec.push_back(6.28);

std::cout << "新double_vec 内存地址: " << static_cast<void *>(double_vec.data()) << std::endl;

std::cout << "double_vec 内容: " << double_vec[0] << ", " << double_vec[1] << std::endl;

std::cout << "\n=== 最终内存统计 ===" << std::endl;

std::cout << "竞技场总内存: " << arena.memory_usage() << " 字节" << std::endl;

std::cout << "活跃内存块数量: " << arena.block_count() << std::endl;

return 0;

}

5. 使用多态内存分配器解决 std::vector 类型不匹配问题

std::vector<int>和std::vector<int, MyAlloc>是完全不同的类型,因为分配器是容器类型的一部分。C++标准库中的容器将分配器作为模板参数,因此不同的分配器会导致不同的类型。

C++17引入了std::pmr(polymorphic memory resource)命名空间,提供了一种多态分配器机制,可以解决这个问题。

std::pmr::polymorphic_allocator:一个通用分配器类型,不将分配器作为类型的一部分std::pmr::memory_resource:所有内存资源的基类std::pmr容器(如std::pmr::vector)都使用polymorphic_allocator,通过内存资源指针管理内存#include <vector>

#include <memory_resource>

#include <array>

// 使用std::pmr::vector和多态分配器

void process(std::pmr::vector<int>& buffer) {

// 处理buffer

}

auto some_func() {

// 创建栈上缓冲区

auto buffer = std::array<std::byte, 512>{};

// 创建内存资源,使用monotonic_buffer_resource(类似您的Arena)

auto resource = std::pmr::monotonic_buffer_resource{

buffer.data(), buffer.size(), std::pmr::new_delete_resource()};

// 创建使用该内存资源的vector

auto vec = std::pmr::vector<int>{&resource};

// 添加元素

vec.push_back(42);

vec.push_back(7);

// 传递给process函数(现在类型匹配)

process(vec);

}

std::pmr::vector<int>使用std::pmr::polymorphic_allocator,它不将分配器作为类型的一部分std::pmr::vector通过内存资源指针(std::pmr::memory_resource*)来管理内存std::pmr容器都使用相同的分配器类型,因此std::pmr::vector<int>和std::pmr::vector<int>是兼容的常用内存资源

C++标准库提供了几种内置内存资源,可以满足不同场景需求:

**std::pmr::monotonic_buffer_resource**:

**std::pmr::unsynchronized_pool_resource**:

**std::pmr::synchronized_pool_resource**:

unsynchronized_pool_resource的线程安全版本实现自定义内存资源

#include <memory_resource>

class PrintingResource : public std::pmr::memory_resource {

public:

PrintingResource() : res_{std::pmr::get_default_resource()} {}

private:

void* do_allocate(std::size_t bytes, std::size_t alignment) override {

std::cout << "allocate: " << bytes << '\n';

return res_->allocate(bytes, alignment);

}

void do_deallocate(void* p, std::size_t bytes,

std::size_t alignment) override {

std::cout << "deallocate: " << bytes << '\n';

res_->deallocate(p, bytes, alignment);

}

bool do_is_equal(const std::pmr::memory_resource& other) const noexcept override {

return this == &other;

}

std::pmr::memory_resource* res_;

};

auto res = PrintingResource{};

auto vec = std::pmr::vector<int>{&res};

vec.emplace_back(1);

vec.emplace_back(2);

注意事项

auto create_vec() -> std::pmr::vector<int> {

auto resource = PrintingResource{};

auto vec = std::pmr::vector<int>{&resource}; // 传递原始指针

return vec; // 资源在函数结束时销毁,vec变成无效

}

auto vec = create_vec();

vec.emplace_back(1); // 未定义行为

std::pmr::get_default_resource()获取默认内存资源,或通过std::pmr::set_default_resource()设置。#include <sys/mman.h>

#include <sys/ipc.h>

#include <sys/shm.h>

#include <fcntl.h>

#include <unistd.h>

#include <stdio.h>

#include <stdlib.h>

// --- 大页内存的不同实现方式 ---

// 1. 显式大页(EHP) + mmap(MAP_HUGETLB),高频交易中使用这种大页方式

// 原理: 在系统启动时通过内核参数 (vm.nr_hugepages 或 hugepages=N) 预留指定数量的大页。

// 应用程序通过 mmap() 配合 MAP_HUGETLB 标志来请求使用这些预留的大页。

// 程序中通过 mmap 使用大页内存(需链接 -lhugetlbfs 库),本质是 mmap() 一个 hugetlbfs 上的文件。

// 高频交易中使用的方式,永久配置(避免重启失效):

// 方式1:编辑 /etc/sysctl.conf,添加配置后永久生效

// sudo vim /etc/sysctl.conf

// 新增行:vm.nr_hugepages = 10 (预留10个大页,数量需根据业务峰值调整)

// 执行 sudo sysctl -p 立即生效,重启后自动加载

// 方式2:若需独立管理配置,创建 /etc/sysctl.d/99-hugepages.conf

// sudo vim /etc/sysctl.d/99-hugepages.conf

// 新增行:vm.nr_hugepages = 10

// 执行 sudo sysctl --system 加载所有配置,重启后自动生效

// 优点: 性能最可预测,开销低,内存页在启动时就已分配,避免运行时碎片。

// 缺点: 需要root权限预配置,预留内存即使不使用也会占用物理内存。

void demonstrate_static_huge_pages() {

printf("\n--- Demonstrating Static Huge Pages with mmap(MAP_HUGETLB) ---\n");

size_t size = 2 * 1024 * 1024; // 2MB,通常为默认大页大小的倍数

void *huge_page_mem = mmap(NULL, size, PROT_READ | PROT_WRITE,

MAP_PRIVATE | MAP_ANONYMOUS | MAP_HUGETLB, -1, 0);

if (huge_page_mem == MAP_FAILED) {

perror("mmap with MAP_HUGETLB failed. Make sure huge pages are configured (e.g., add 'vm.nr_hugepages=1' to /etc/sysctl.conf and run 'sudo sysctl -p') and available.");

return;

}

printf("Successfully allocated static huge page memory at %p\n", huge_page_mem);

int *data = (int *)huge_page_mem;

data[0] = 123;

printf("Data at huge page: %d\n", data[0]);

if (munmap(huge_page_mem, size) == -1) {

perror("munmap failed");

}

printf("Successfully unmapped static huge page memory.\n");

}

// 2. 透明大页 (THP) + madvise(MADV_HUGEPAGE) (可选)

// 原理: 内核特性,尝试在后台自动将4KB小页合并为大页(通常2MB)。

// 应用程序无需明确请求,但可以通过 madvise() 提供提示以优化内核的行为。

// 高频交易关键配置(必须禁用THP,消除不确定性):

// 永久禁用THP(避免重启后内核自动启用):

// 方式1:编辑 /etc/sysctl.conf,添加禁用配置

// sudo vim /etc/sysctl.conf

// 新增行:vm.transparent_hugepage.enabled = never

// vm.transparent_hugepage.defrag = never (同时禁用碎片整理)

// 执行 sudo sysctl -p 立即生效

// 方式2:通过 grub 内核参数永久禁用(适用于需要完全屏蔽THP的场景)

// sudo vim /etc/default/grub

// 修改 GRUB_CMDLINE_LINUX 为:GRUB_CMDLINE_LINUX="transparent_hugepage=never"

// 执行 sudo update-grub 更新 grub 配置,重启系统后生效

// 优点: 对应用程序透明,无需代码修改即可受益。

// 缺点: 可能因内存碎片化难以分配,或导致性能抖动和内存膨胀,

// 此外,munmap、madvise等系统调用会影响内核必须在进程的组成线程之间通信的地址空间更改类型,造成TLB驱逐。

// 在高频交易中设置 transparent_hugepage=never禁止内核在后台自动整理内存,消除不可预测的暂停。

void demonstrate_transparent_huge_pages() {

printf("\n--- Demonstrating Transparent Huge Pages (THP) ---\n");

// 分配普通内存,THP 会尝试将其转换为大页

size_t size = 4 * 1024 * 1024; // 4MB

void *normal_mem = malloc(size);

if (!normal_mem) {

perror("malloc failed");

return;

}

printf("Successfully allocated normal memory at %p\n", normal_mem);

// 可选:使用 madvise 提示内核尝试使用大页

// (仅当 /sys/kernel/mm/transparent_hugepage/enabled 设置为 madvise 或 always 时有效,高频场景中此配置已禁用)

if (madvise(normal_mem, size, MADV_HUGEPAGE) == -1) {

perror("madvise(MADV_HUGEPAGE) failed (THP is disabled in HFT scenario, set 'vm.transparent_hugepage.enabled=never' in /etc/sysctl.conf)");

// 应用程序可以继续使用普通内存

} else {

printf("madvise(MADV_HUGEPAGE) successful, kernel may convert to huge pages (not recommended in HFT).\n");

}

// 像使用普通内存一样使用

char *data = (char *)normal_mem;

data[0] = 'A';

printf("Data in potentially THP-backed memory: %c\n", data[0]);

free(normal_mem);

printf("Successfully freed memory (potentially THP-backed).\n");

}

// 3. System V IPC 共享内存 + SHM_HUGETLB

// 原理: 使用 System V 共享内存接口 shmget() 结合 SHM_HUGETLB 标志来创建大页共享内存段。

// 依赖的大页永久配置(与显式大页一致):

// 需先按显式大页配置方式,在 /etc/sysctl.conf 或 /etc/sysctl.d/ 中设置 vm.nr_hugepages=10(示例值),

// 确保系统启动时预留足够大页,避免运行时分配失败(高频场景不允许动态调整)

// 优点: 直接就是可以被多个进程挂载的匿名内存,随内核持续。

// 除非被显式删除 (ipcrm 或 shmctl with IPC_RMID) 或系统重启,

// 否则共享内存段会一直存在,即使创建它的进程已经退出。

// 缺点: 接口相对复杂,不如 mmap() 灵活。

void demonstrate_systemv_huge_pages() {

printf("\n--- Demonstrating System V IPC Huge Pages ---\n");

size_t size = 2 * 1024 * 1024; // 2MB

int shm_id;

void *shm_addr;

// 创建共享内存段,并指定 SHM_HUGETLB 标志

shm_id = shmget(IPC_PRIVATE, size, IPC_CREAT | SHM_R | SHM_W | SHM_HUGETLB);

if (shm_id == -1) {

perror("shmget with SHM_HUGETLB failed. Ensure huge pages are configured (add 'vm.nr_hugepages=10' to /etc/sysctl.conf and run 'sudo sysctl -p') and available.");

return;

}

printf("Successfully created huge page shared memory with ID: %d\n", shm_id);

// 将共享内存附加到进程地址空间

shm_addr = shmat(shm_id, NULL, 0);

if (shm_addr == (void *)-1) {

perror("shmat failed");

shmctl(shm_id, IPC_RMID, NULL); // 清理

return;

}

printf("Successfully attached huge page shared memory at %p\n", shm_addr);

int *data = (int *)shm_addr;

data[0] = 456;

printf("Data in huge page shared memory: %d\n", data[0]);

// 分离共享内存

if (shmdt(shm_addr) == -1) {

perror("shmdt failed");

}

// 标记共享内存段为删除,当所有进程都分离后将被删除

if (shmctl(shm_id, IPC_RMID, NULL) == -1) {

perror("shmctl IPC_RMID failed");

}

printf("Successfully detached and marked shared memory for deletion.\n");

}

// 4. 大页文件系统 (Hugetlbfs)

// 原理: 专门用于支持大页的文件系统 (通常挂载在 /mnt/huge)。

// 高频交易永久配置(挂载+大页预留,确保重启后可用):

// 步骤1:永久预留大页(同显式大页配置)

// sudo vim /etc/sysctl.conf

// 新增:vm.nr_hugepages = 10 ,执行 sudo sysctl -p 生效

// 步骤2:永久挂载 hugetlbfs 到 /mnt/huge(避免重启后需重新挂载)

// sudo vim /etc/fstab

// 新增行:hugetlbfs /mnt/huge hugetlbfs defaults 0 0

// 执行 sudo mkdir -p /mnt/huge 创建目录,再执行 sudo mount /mnt/huge 立即挂载

// 重启后系统会自动从 /etc/fstab 加载挂载配置

// 此时 /mnt/huge 目录下创建的文件会直接关联到物理大页内存,无需临时挂载操作

// 优点: 可以通过文件路径来标识和访问大页,易于管理和共享。

// 缺点: 需要root权限挂载 hugetlbfs。

void demonstrate_hugetlbfs() {

printf("\n--- Demonstrating Hugetlbfs ---\n");

const char *filepath = "/mnt/huge/my_huge_file"; // 依赖 /mnt/huge 永久挂载(配置在 /etc/fstab)

size_t size = 2 * 1024 * 1024; // 2MB

int fd = open(filepath, O_CREAT | O_RDWR, 0755);

if (fd == -1) {

perror("open hugetlbfs file failed. Make sure: 1. 'vm.nr_hugepages' is set in /etc/sysctl.conf; 2. hugetlbfs is mounted permanently via /etc/fstab (hugetlbfs /mnt/huge hugetlbfs defaults 0 0); 3. /mnt/huge is writable.");

return;

}

if (ftruncate(fd, size) == -1) {

perror("ftruncate failed");

close(fd);

return;

}

void *huge_mem = mmap(NULL, size, PROT_READ | PROT_WRITE, MAP_SHARED, fd, 0);

if (huge_mem == MAP_FAILED) {

perror("mmap hugetlbfs file failed. Check if huge pages are reserved (via /etc/sysctl.conf) and hugetlbfs is mounted.");

close(fd);

return;

}

printf("Successfully mapped huge page memory from file at %p\n", huge_mem);

int *data = (int *)huge_mem;

data[0] = 789;

printf("Data in huge page file mapped memory: %d\n", data[0]);

if (munmap(huge_mem, size) == -1) {

perror("munmap failed");

}

close(fd);

unlink(filepath); // 清理创建的文件

printf("Successfully unmapped and deleted hugetlbfs file.\n");

}

int main() {

// 运行前必须完成的永久配置:

// 1. 预留显式大页:在 /etc/sysctl.conf 或 /etc/sysctl.d/ 中设置 vm.nr_hugepages=10,执行 sudo sysctl -p 生效

// 2. 禁用透明大页:在 /etc/sysctl.conf 中设置 vm.transparent_hugepage.enabled=never,执行 sudo sysctl -p 生效

// 3. 永久挂载 hugetlbfs:在 /etc/fstab 中添加 hugetlbfs /mnt/huge hugetlbfs defaults 0 0,执行 sudo mount /mnt/huge 生效

demonstrate_static_huge_pages();

demonstrate_transparent_huge_pages();

demonstrate_systemv_huge_pages();

demonstrate_hugetlbfs();

printf("\n--- End of Huge Pages Demonstration ---\n");

return 0;

}

hugePageAllocator(非STL兼容),可直接改造依赖C风格数组的对象池的实现

#pragma once

#include <cstddef>

#include <linux/mman.h>

#include <sys/mman.h>

#include <unistd.h>

#include <cstdlib>

#include <cstdio>

#include <cstdint>

#ifdef HUGE_PAGE_ALLOCATOR_DEBUG

#define HPA_DEBUG_PRINT(fmt, ...) fprintf(stderr, "[HugePageAllocator] " fmt, ##__VA_ARGS__)

#else

#define HPA_DEBUG_PRINT(fmt, ...) do {} while(0)

#endif

/**

* @brief 一个高性能的大页内存分配器

*

* 该分配器使用Linux的大页内存(mmap)来提供更高效的内存分配

*/

class HugePageAllocator

{

public:

// 大页类型枚举

enum class HugePageSize {

DEFAULT, // 让系统自动选择

HUGETLB_2MB, // 2MB大页